Article original : The Docker Handbook – Learn Docker for Beginners

Le concept de conteneurisation lui-même est assez ancien. Mais l'émergence du Docker Engine en 2013 a rendu beaucoup plus facile la conteneurisation de vos applications.

Selon l'Enquête des développeurs Stack Overflow - 2020, Docker est la plateforme la plus souhaitée, la plateforme la plus aimée, et également la plateforme la plus populaire.

Bien que cela soit très demandé, commencer peut sembler un peu intimidant au début. Alors dans ce livre, nous allons apprendre tout, des bases à un niveau plus intermédiaire de la conteneurisation. Après avoir parcouru l'ensemble du livre, vous devriez être capable de :

- Conteneuriser (presque) n'importe quelle application

- Télécharger des images Docker personnalisées vers des registres en ligne

- Travailler avec plusieurs conteneurs en utilisant Docker Compose

Prérequis

- Familiarité avec le terminal Linux

- Familiarité avec JavaScript (certains projets ultérieurs utilisent JavaScript)

Table des matières

- Introduction à la conteneurisation et Docker

- Comment installer Docker

- Hello World dans Docker - Introduction aux bases de Docker

- Bases de la manipulation des conteneurs Docker

- Comment exécuter un conteneur

- Comment publier un port

- Comment utiliser le mode détaché

- Comment lister les conteneurs

- Comment nommer ou renommer un conteneur

- Comment arrêter ou tuer un conteneur en cours d'exécution

- Comment redémarrer un conteneur

- Comment créer un conteneur sans l'exécuter

- Comment supprimer les conteneurs suspendus

- Comment exécuter un conteneur en mode interactif

- Comment exécuter des commandes à l'intérieur d'un conteneur

- Comment travailler avec des images exécutables

- Bases de la manipulation des images Docker

- Comment créer une image Docker

- Comment étiqueter les images Docker

- Comment lister et supprimer les images Docker

- Comment comprendre les nombreuses couches d'une image Docker

- Comment construire NGINX à partir de la source

- Comment optimiser les images Docker

- Embrasser Alpine Linux

- Comment créer des images Docker exécutables

- Comment partager vos images Docker en ligne

- Comment conteneuriser une application JavaScript

- Bases de la manipulation du réseau dans Docker

- Comment conteneuriser une application JavaScript multi-conteneurs

- Comment exécuter le serveur de base de données

- Comment travailler avec des volumes nommés dans Docker

- Comment accéder aux journaux depuis un conteneur dans Docker

- Comment créer un réseau et attacher le serveur de base de données dans Docker

- Comment écrire le Dockerfile

- Comment exécuter des commandes dans un conteneur en cours d'exécution

- Comment écrire des scripts de gestion dans Docker

- Comment composer des projets en utilisant Docker-Compose

- Bases de Docker Compose

- Comment démarrer les services dans Docker Compose

- Comment lister les services dans Docker Compose

- Comment exécuter des commandes à l'intérieur d'un service en cours d'exécution dans Docker Compose

- Comment accéder aux journaux depuis un service en cours d'exécution dans Docker Compose

- Comment arrêter les services dans Docker Compose

- Comment composer une application full-stack dans Docker Compose

- Conclusion

Code du projet

Le code des projets d'exemple peut être trouvé dans le dépôt suivant :

Vous pouvez trouver le code complet dans la branche completed.

Contributions

Ce livre est entièrement open-source et les contributions de qualité sont les bienvenues. Vous pouvez trouver le contenu complet dans le dépôt suivant :

Je fais généralement mes modifications et mises à jour sur la version GitBook du livre en premier, puis je les publie sur freeCodeCamp. Vous pouvez trouver la version toujours mise à jour et souvent instable du livre au lien suivant :

Si vous cherchez une version figée mais stable du livre, alors freeCodeCamp sera le meilleur endroit où aller :

Quelle que soit la version du livre que vous finissez par lire, n'oubliez pas de me faire savoir votre opinion. Les critiques constructives sont toujours les bienvenues.

Introduction à la conteneurisation et Docker

Selon IBM,

La conteneurisation implique l'encapsulation ou l'empaquetage du code logiciel et de toutes ses dépendances afin qu'il puisse s'exécuter uniformément et de manière cohérente sur toute infrastructure.

En d'autres termes, la conteneurisation vous permet de regrouper votre logiciel avec toutes ses dépendances dans un package autonome afin qu'il puisse être exécuté sans passer par un processus de configuration fastidieux.

Considérons un scénario réel ici. Supposons que vous avez développé une application de gestion de livres géniale qui peut stocker des informations concernant tous les livres que vous possédez, et qui peut également servir de système de prêt de livres pour vos amis.

Si vous faites une liste des dépendances, cette liste peut ressembler à ce qui suit :

- Node.js

- Express.js

- SQLite3

Eh bien, théoriquement, cela devrait suffire. Mais pratiquement, il y a aussi d'autres choses. Il s'avère que Node.js utilise un outil de construction connu sous le nom de node-gyp pour construire des modules complémentaires natifs. Et selon les instructions d'installation dans le dépôt officiel, cet outil de construction nécessite Python 2 ou 3 et une chaîne d'outils de compilation C/C++ appropriée.

En tenant compte de tout cela, la liste finale des dépendances est la suivante :

- Node.js

- Express.js

- SQLite3

- Python 2 ou 3

- Chaîne d'outils C/C++

L'installation de Python 2 ou 3 est assez simple quelle que soit la plateforme que vous utilisez. La configuration de la chaîne d'outils C/C++ est assez facile sur Linux, mais sur Windows et Mac, c'est une tâche pénible.

Sur Windows, le package d'outils de construction C++ mesure des gigaoctets et prend un certain temps à installer. Sur un Mac, vous pouvez soit installer l'application gigantesque Xcode, soit le package beaucoup plus petit Command Line Tools for Xcode.

Quelle que soit celle que vous installez, elle peut encore se casser lors des mises à jour du système d'exploitation. En fait, le problème est si répandu qu'il existe des notes d'installation pour macOS Catalina disponibles sur le dépôt officiel.

Supposons que vous avez traversé toutes les difficultés de configuration des dépendances et que vous avez commencé à travailler sur le projet. Cela signifie-t-il que vous êtes hors de danger maintenant ? Bien sûr que non.

Que se passe-t-il si vous avez un coéquipier qui utilise Windows alors que vous utilisez Linux. Maintenant, vous devez prendre en compte les incohérences de la manière dont ces deux systèmes d'exploitation différents gèrent les chemins. Ou le fait que des technologies populaires comme nginx ne sont pas bien optimisées pour fonctionner sur Windows. Certaines technologies comme Redis ne sont même pas pré-construites pour Windows.

Même si vous passez toute la phase de développement, que se passe-t-il si la personne responsable de la gestion des serveurs suit la mauvaise procédure de déploiement ?

Tous ces problèmes peuvent être résolus si seulement vous pouviez d'une manière ou d'une autre :

- Développer et exécuter l'application dans un environnement isolé (appelé conteneur) qui correspond à votre environnement de déploiement final.

- Mettre votre application dans un seul fichier (appelé image) avec toutes ses dépendances et les configurations de déploiement nécessaires.

- Et partager cette image via un serveur central (appelé registre) accessible par toute personne avec une autorisation appropriée.

Vos coéquipiers pourront alors télécharger l'image depuis le registre, exécuter l'application telle quelle dans un environnement isolé, exempt des incohérences spécifiques à la plateforme, ou même déployer directement sur un serveur, puisque l'image contient toutes les configurations de production appropriées.

C'est l'idée derrière la conteneurisation : mettre vos applications dans un package autonome, les rendant portables et reproductibles dans divers environnements.

Maintenant, la question est « Quel rôle Docker joue-t-il ici ? »

Comme je l'ai déjà expliqué, la conteneurisation est une idée qui résout une myriade de problèmes dans le développement logiciel en mettant les choses dans des boîtes.

Cette idée a plusieurs implémentations. Docker est une telle implémentation. C'est une plateforme de conteneurisation open-source qui vous permet de conteneuriser vos applications, de les partager en utilisant des registres publics ou privés, et aussi de les orchestrer.

Maintenant, Docker n'est pas le seul outil de conteneurisation sur le marché, c'est simplement le plus populaire. Un autre moteur de conteneurisation que j'aime s'appelle Podman développé par Red Hat. D'autres outils comme Kaniko par Google, rkt par CoreOS sont incroyables, mais ils ne sont pas encore prêts à être un remplacement direct pour Docker.

De plus, si vous voulez une leçon d'histoire, vous pouvez lire l'incroyable Une brève histoire des conteneurs : des années 1970 à aujourd'hui qui couvre la plupart des principaux tournants de la technologie.

Comment installer Docker

L'installation de Docker varie considérablement en fonction du système d'exploitation que vous utilisez. Mais elle est universellement simple sur tous les systèmes.

Docker fonctionne parfaitement sur les trois principales plateformes, Mac, Windows et Linux. Parmi les trois, le processus d'installation sur Mac est le plus facile, donc nous allons commencer par là.

Comment installer Docker sur macOS

Sur un Mac, tout ce que vous avez à faire est de naviguer vers la page de téléchargement officielle et de cliquer sur le bouton Download for Mac (stable).

Vous obtiendrez un fichier Apple Disk Image d'apparence régulière et à l'intérieur du fichier, il y aura l'application. Tout ce que vous avez à faire est de glisser le fichier et de le déposer dans votre répertoire Applications.

Vous pouvez démarrer Docker en double-cliquant simplement sur l'icône de l'application. Une fois l'application démarrée, vous verrez l'icône Docker apparaître dans votre barre de menu.

![]()

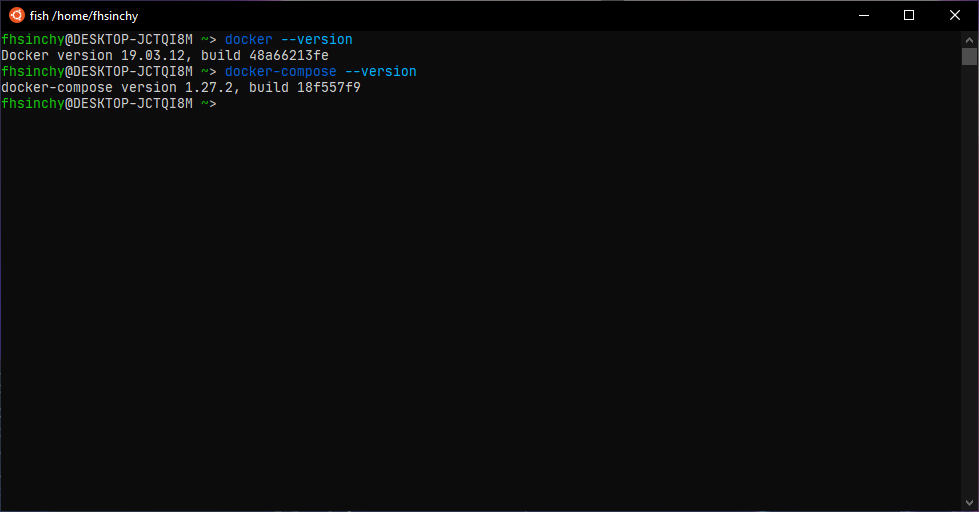

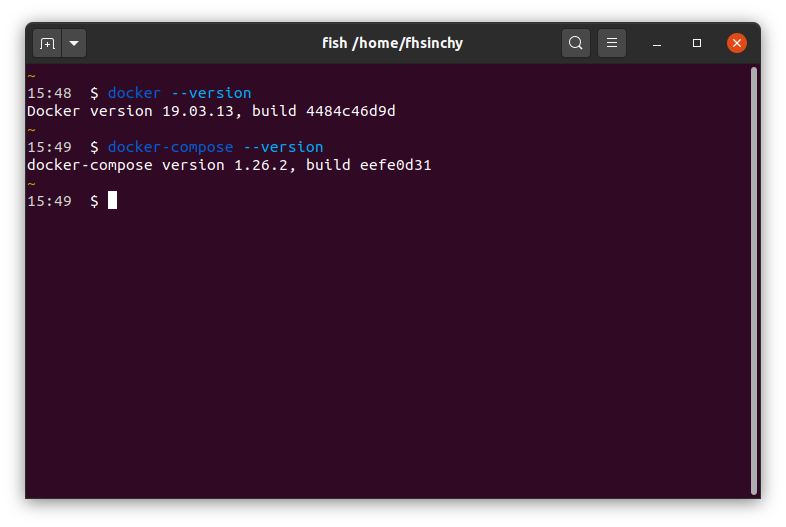

Maintenant, ouvrez le terminal et exécutez docker --version et docker-compose --version pour vous assurer du succès de l'installation.

Comment installer Docker sur Windows

Sur Windows, la procédure est presque la même, sauf qu'il y a quelques étapes supplémentaires que vous devrez suivre. Les étapes d'installation sont les suivantes :

- Naviguez vers ce site et suivez les instructions pour installer WSL2 sur Windows 10.

- Ensuite, naviguez vers la page de téléchargement officielle et cliquez sur le bouton Download for Windows (stable).

- Double-cliquez sur l'installateur téléchargé et passez par l'installation avec les paramètres par défaut.

Une fois l'installation terminée, démarrez Docker Desktop soit à partir du menu démarrer soit de votre bureau. L'icône docker devrait apparaître sur votre barre des tâches.

![]()

Maintenant, ouvrez Ubuntu ou toute autre distribution que vous avez installée depuis le Microsoft Store. Exécutez les commandes docker --version et docker-compose --version pour vous assurer que l'installation a réussi.

Vous pouvez également accéder à Docker depuis votre invite de commande ou PowerShell habituel. C'est juste que je préfère utiliser WSL2 plutôt que toute autre ligne de commande sur Windows.

Comment installer Docker sur Linux

L'installation de Docker sur Linux est un processus un peu différent, et selon la distribution que vous utilisez, cela peut varier encore plus. Mais pour être honnête, l'installation est tout aussi facile (si ce n'est plus facile) que les deux autres plateformes.

Le package Docker Desktop sur Windows ou Mac est une collection d'outils comme Docker Engine, Docker Compose, Docker Dashboard, Kubernetes et quelques autres goodies.

Sur Linux, cependant, vous n'obtenez pas un tel bundle. Au lieu de cela, vous installez tous les outils nécessaires manuellement. Les procédures d'installation pour différentes distributions sont les suivantes :

- Si vous êtes sur Ubuntu, vous pouvez suivre la section Install Docker Engine on Ubuntu de la documentation officielle.

- Pour les autres distributions, des guides d'installation par distribution sont disponibles dans la documentation officielle.

- Si vous êtes sur une distribution qui n'est pas listée dans la documentation, vous pouvez suivre le guide Install Docker Engine from binaries à la place.

- Quelle que soit la procédure que vous suivez, vous devrez passer par certaines étapes post-installation pour Linux qui sont très importantes.

- Une fois que vous avez terminé l'installation de docker, vous devrez installer un autre outil nommé Docker Compose. Vous pouvez suivre le guide Install Docker Compose de la documentation officielle.

Une fois l'installation terminée, ouvrez le terminal et exécutez docker --version et docker-compose --version pour vous assurer du succès de l'installation.

Bien que Docker fonctionne assez bien quelle que soit la plateforme que vous utilisez, je préfère Linux aux autres. Tout au long du livre, je vais alterner entre mes stations de travail Ubuntu 20.10 et Fedora 33.

Une autre chose que je voudrais clarifier dès le départ, c'est que je n'utiliserai aucun outil GUI pour travailler avec Docker tout au long du livre.

Je suis conscient des bons outils GUI disponibles pour différentes plateformes, mais l'apprentissage des commandes docker courantes est l'un des objectifs principaux de ce livre.

Hello World dans Docker – Introduction aux bases de Docker

Maintenant que vous avez Docker en cours d'exécution sur votre machine, il est temps pour vous d'exécuter votre premier conteneur. Ouvrez le terminal et exécutez la commande suivante :

docker run hello-world

# Unable to find image 'hello-world:latest' locally

# latest: Pulling from library/hello-world

# 0e03bdcc26d7: Pull complete

# Digest: sha256:4cf9c47f86df71d48364001ede3a4fcd85ae80ce02ebad74156906caff5378bc

# Status: Downloaded newer image for hello-world:latest

#

# Hello from Docker!

# This message shows that your installation appears to be working correctly.

#

# To generate this message, Docker took the following steps:

# 1. The Docker client contacted the Docker daemon.

# 2. The Docker daemon pulled the "hello-world" image from the Docker Hub.

# (amd64)

# 3. The Docker daemon created a new container from that image which runs the

# executable that produces the output you are currently reading.

# 4. The Docker daemon streamed that output to the Docker client, which sent it

# to your terminal.

#

# To try something more ambitious, you can run an Ubuntu container with:

# $ docker run -it ubuntu bash

#

# Share images, automate workflows, and more with a free Docker ID:

# https://hub.docker.com/

#

# For more examples and ideas, visit:

# https://docs.docker.com/get-started/

L'image hello-world est un exemple de conteneurisation minimale avec Docker. Elle contient un seul programme compilé à partir d'un fichier hello.c responsable de l'impression du message que vous voyez sur votre terminal.

Maintenant, dans votre terminal, vous pouvez utiliser la commande docker ps -a pour jeter un coup d'œil à tous les conteneurs qui sont actuellement en cours d'exécution ou qui ont été exécutés dans le passé :

docker ps -a

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# 128ec8ceab71 hello-world "/hello" 14 seconds ago Exited (0) 13 seconds ago exciting_chebyshev

Dans la sortie, un conteneur nommé exciting_chebyshev a été exécuté avec l'identifiant de conteneur 128ec8ceab71 en utilisant l'image hello-world. Il a Exited (0) 13 seconds ago où le code de sortie (0) signifie qu'aucune erreur n'a été produite pendant l'exécution du conteneur.

Maintenant, afin de comprendre ce qui vient de se passer en coulisses, vous devez vous familiariser avec l'architecture Docker et trois concepts très fondamentaux de la conteneurisation en général, qui sont les suivants :

- Conteneur

- Image

- Registre

J'ai listé les trois concepts par ordre alphabétique et commencerai mes explications avec le premier de la liste.

Qu'est-ce qu'un conteneur ?

Dans le monde de la conteneurisation, il ne peut y avoir rien de plus fondamental que le concept de conteneur.

Le site officiel des ressources Docker resources dit -

Un conteneur est une abstraction au niveau de l'application qui regroupe le code et les dépendances. Au lieu de virtualiser toute la machine physique, les conteneurs virtualisent uniquement le système d'exploitation hôte.

Vous pouvez considérer les conteneurs comme la prochaine génération de machines virtuelles.

Tout comme les machines virtuelles, les conteneurs sont des environnements complètement isolés du système hôte ainsi que les uns des autres. Ils sont également beaucoup plus légers que la machine virtuelle traditionnelle, donc un grand nombre de conteneurs peuvent être exécutés simultanément sans affecter les performances du système hôte.

Les conteneurs et les machines virtuelles sont en fait différentes façons de virtualiser votre matériel physique. La principale différence entre ces deux méthodes est la méthode de virtualisation.

Les machines virtuelles sont généralement créées et gérées par un programme connu sous le nom d'hyperviseur, comme Oracle VM VirtualBox, VMware Workstation, KVM, Microsoft Hyper-V et ainsi de suite. Ce programme hyperviseur se place généralement entre le système d'exploitation hôte et les machines virtuelles pour servir de moyen de communication.

Chaque machine virtuelle est livrée avec son propre système d'exploitation invité qui est tout aussi lourd que le système d'exploitation hôte.

L'application s'exécutant à l'intérieur d'une machine virtuelle communique avec le système d'exploitation invité, qui parle à l'hyperviseur, qui parle ensuite au système d'exploitation hôte pour allouer les ressources nécessaires de l'infrastructure physique à l'application en cours d'exécution.

Comme vous pouvez le voir, il y a une longue chaîne de communication entre les applications s'exécutant à l'intérieur des machines virtuelles et l'infrastructure physique. L'application s'exécutant à l'intérieur de la machine virtuelle peut ne prendre qu'une petite quantité de ressources, mais le système d'exploitation invité ajoute un surcoût notable.

Contrairement à une machine virtuelle, un conteneur effectue le travail de virtualisation de manière plus intelligente. Au lieu d'avoir un système d'exploitation invité complet à l'intérieur d'un conteneur, il utilise simplement le système d'exploitation hôte via le runtime du conteneur tout en maintenant l'isolation – tout comme une machine virtuelle traditionnelle.

Le runtime du conteneur, c'est-à-dire Docker, se place entre les conteneurs et le système d'exploitation hôte au lieu d'un hyperviseur. Les conteneurs communiquent ensuite avec le runtime du conteneur qui communique ensuite avec le système d'exploitation hôte pour obtenir les ressources nécessaires de l'infrastructure physique.

En conséquence de l'élimination de toute la couche du système d'exploitation invité, les conteneurs sont beaucoup plus légers et moins gourmands en ressources que les machines virtuelles traditionnelles.

Pour démontrer ce point, regardez le bloc de code suivant :

uname -a

# Linux alpha-centauri 5.8.0-22-generic #23-Ubuntu SMP Fri Oct 9 00:34:40 UTC 2020 x86_64 x86_64 x86_64 GNU/Linux

docker run alpine uname -a

# Linux f08dbbe9199b 5.8.0-22-generic #23-Ubuntu SMP Fri Oct 9 00:34:40 UTC 2020 x86_64 Linux

Dans le bloc de code ci-dessus, j'ai exécuté la commande uname -a sur mon système d'exploitation hôte pour imprimer les détails du noyau. Ensuite, sur la ligne suivante, j'ai exécuté la même commande à l'intérieur d'un conteneur exécutant Alpine Linux.

Comme vous pouvez le voir dans la sortie, le conteneur utilise effectivement le noyau de mon système d'exploitation hôte. Cela prouve le point que les conteneurs virtualisent le système d'exploitation hôte au lieu d'avoir leur propre système d'exploitation.

Si vous êtes sur une machine Windows, vous découvrirez que tous les conteneurs utilisent le noyau WSL2. Cela se produit parce que WSL2 agit comme le backend pour Docker sur Windows. Sur macOS, le backend par défaut est une VM s'exécutant sur l'hyperviseur HyperKit.

Qu'est-ce qu'une image Docker ?

Les images sont des fichiers autonomes à plusieurs couches qui servent de modèle pour la création de conteneurs. Elles sont comme une copie gelée et en lecture seule d'un conteneur. Les images peuvent être échangées via des registres.

Par le passé, différents moteurs de conteneurs avaient différents formats d'images. Mais plus tard, l'Open Container Initiative (OCI) a défini une spécification standard pour les images de conteneurs, qui est respectée par les principaux moteurs de conteneurisation. Cela signifie qu'une image construite avec Docker peut être utilisée avec un autre runtime comme Podman sans aucun problème supplémentaire.

Les conteneurs ne sont que des images en état d'exécution. Lorsque vous obtenez une image depuis Internet et exécutez un conteneur en utilisant cette image, vous créez essentiellement une autre couche temporaire modifiable par-dessus les précédentes couches en lecture seule.

Ce concept deviendra beaucoup plus clair dans les sections à venir de ce livre. Mais pour l'instant, gardez simplement à l'esprit que les images sont des fichiers en lecture seule à plusieurs couches transportant votre application dans un état souhaité.

Qu'est-ce qu'un registre Docker ?

Vous avez déjà appris deux pièces très importantes du puzzle, les Conteneurs et les Images. La pièce finale est le Registre.

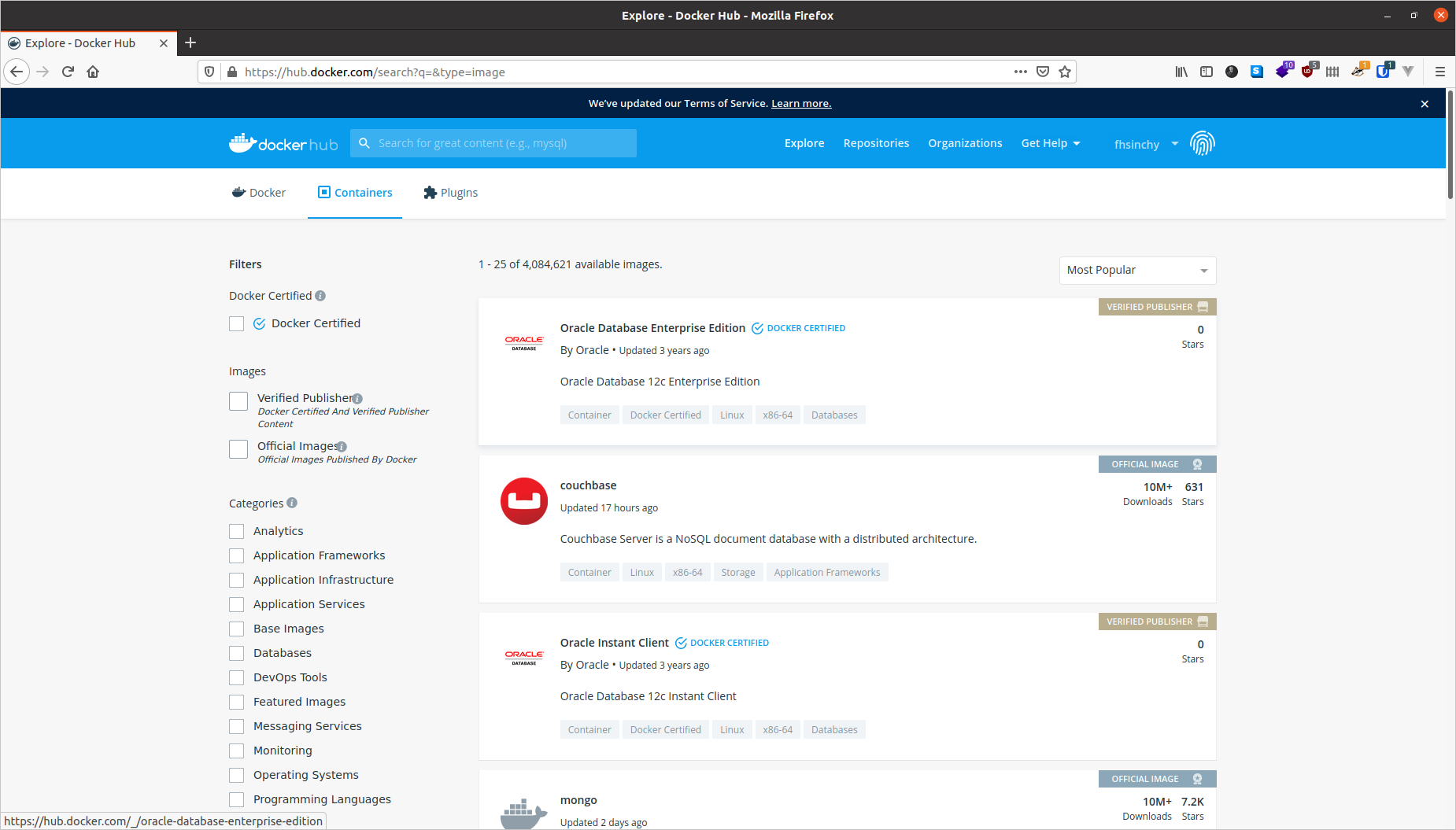

Un registre d'images est un endroit centralisé où vous pouvez télécharger vos images et également télécharger des images créées par d'autres. Docker Hub est le registre public par défaut pour Docker. Un autre registre d'images très populaire est Quay de Red Hat.

Tout au long de ce livre, j'utiliserai Docker Hub comme registre de mon choix.

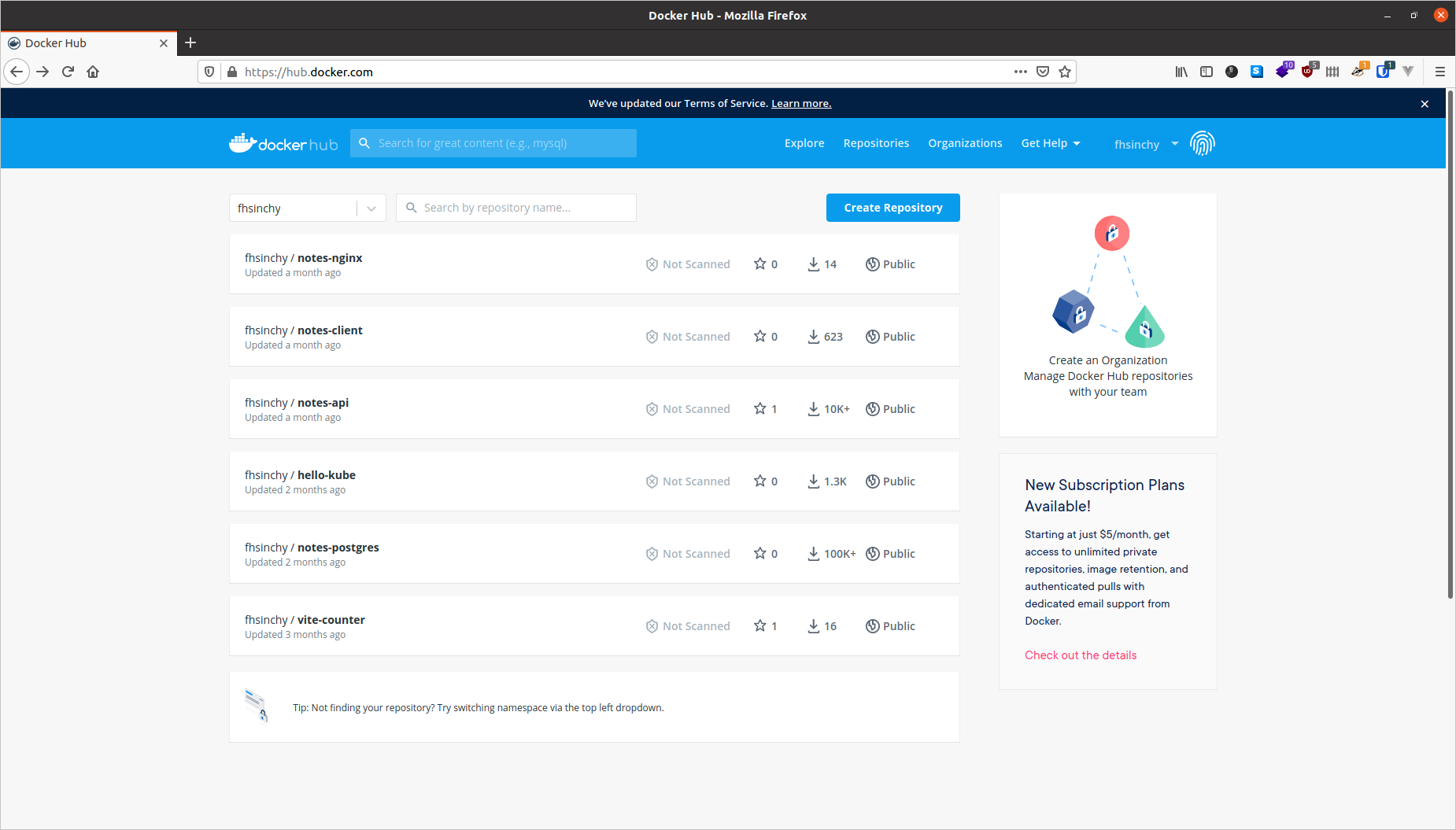

Vous pouvez partager n'importe quel nombre d'images publiques sur Docker Hub gratuitement. Les gens du monde entier pourront les télécharger et les utiliser librement. Les images que j'ai téléchargées sont disponibles sur ma page de profil (fhsinchy).

En dehors de Docker Hub ou Quay, vous pouvez également créer votre propre registre d'images pour héberger des images privées. Il existe également un registre local qui s'exécute sur votre ordinateur et qui met en cache les images téléchargées depuis les registres distants.

Aperçu de l'architecture Docker

Maintenant que vous êtes familier avec la plupart des concepts fondamentaux concernant la conteneurisation et Docker, il est temps pour vous de comprendre comment Docker, en tant que logiciel, a été conçu.

Le moteur se compose de trois composants principaux :

- Docker Daemon : Le démon (

dockerd) est un processus qui continue de s'exécuter en arrière-plan et attend les commandes du client. Le démon est capable de gérer divers objets Docker. - Docker Client : Le client (

docker) est un programme d'interface de ligne de commande principalement responsable du transport des commandes émises par les utilisateurs. - REST API : L'API REST agit comme un pont entre le démon et le client. Toute commande émise à l'aide du client passe par l'API pour atteindre enfin le démon.

Selon la documentation officielle docs,

« Docker utilise une architecture client-serveur. Le client Docker parle au démon Docker, qui effectue le travail lourd de construction, d'exécution et de distribution de vos conteneurs Docker ».

En tant qu'utilisateur, vous exécuterez généralement des commandes en utilisant le composant client. Le client utilise ensuite l'API REST pour atteindre le démon en cours d'exécution et faire votre travail.

Le tableau complet

D'accord, assez parlé. Maintenant, il est temps pour vous de comprendre comment toutes ces pièces du puzzle que vous venez d'apprendre fonctionnent en harmonie. Avant de plonger dans l'explication de ce qui se passe réellement lorsque vous exécutez la commande docker run hello-world, laissez-moi vous montrer un petit diagramme que j'ai fait :

Cette image est une version légèrement modifiée de celle trouvée dans la documentation officielle docs. Les événements qui se produisent lorsque vous exécutez la commande sont les suivants :

- Vous exécutez la commande

docker run hello-worldoùhello-worldest le nom d'une image. - Le client Docker contacte le démon et lui demande d'obtenir l'image

hello-worldet d'exécuter un conteneur à partir de celle-ci. - Le démon Docker recherche l'image dans votre dépôt local et réalise qu'elle n'y est pas, ce qui entraîne l'impression de

Unable to find image 'hello-world:latest' locallysur votre terminal. - Le démon contacte ensuite le registre public par défaut, qui est Docker Hub, et télécharge la dernière copie de l'image

hello-world, indiquée par la lignelatest: Pulling from library/hello-worlddans votre terminal. - Le démon Docker crée ensuite un nouveau conteneur à partir de l'image fraîchement téléchargée.

- Enfin, le démon Docker exécute le conteneur créé en utilisant l'image

hello-world, affichant le mur de texte sur votre terminal.

C'est le comportement par défaut du démon Docker de rechercher des images dans le hub qui ne sont pas présentes localement. Mais une fois qu'une image a été récupérée, elle restera dans le cache local. Donc si vous exécutez la commande à nouveau, vous ne verrez pas les lignes suivantes dans la sortie :

Unable to find image 'hello-world:latest' locally

latest: Pulling from library/hello-world

0e03bdcc26d7: Pull complete

Digest: sha256:d58e752213a51785838f9eed2b7a498ffa1cb3aa7f946dda11af39286c3db9a9

Status: Downloaded newer image for hello-world:latest

S'il existe une version plus récente de l'image disponible sur le registre public, le démon récupérera à nouveau l'image. Ce :latest est une balise. Les images ont généralement des balises significatives pour indiquer les versions ou les builds. Vous en apprendrez plus à ce sujet plus tard.

Bases de la manipulation des conteneurs Docker

Dans les sections précédentes, vous avez appris les éléments de base de Docker et avez également exécuté un conteneur en utilisant la commande docker run.

Dans cette section, vous apprendrez la manipulation des conteneurs de manière beaucoup plus détaillée. La manipulation des conteneurs est l'une des tâches les plus courantes que vous effectuerez chaque jour, donc avoir une compréhension appropriée des différentes commandes est crucial.

Gardez à l'esprit, cependant, que ceci n'est pas une liste exhaustive de toutes les commandes que vous pouvez exécuter sur Docker. Je ne parlerai que des plus courantes. Chaque fois que vous voulez en savoir plus sur les commandes disponibles, visitez simplement la référence officielle pour la ligne de commande Docker.

Comment exécuter un conteneur

Précédemment, vous avez utilisé docker run pour créer et démarrer un conteneur en utilisant l'image hello-world. La syntaxe générique de cette commande est la suivante :

docker run <nom de l'image>

Bien que ce soit une commande parfaitement valide, il existe une meilleure façon d'envoyer des commandes au démon docker.

Avant la version 1.13, Docker n'avait que la syntaxe de commande mentionnée précédemment. Plus tard, la ligne de commande a été restructurée pour avoir la syntaxe suivante :

docker <objet> <commande> <options>

Dans cette syntaxe :

objetindique le type d'objet Docker que vous allez manipuler. Cela peut être un objetcontainer,image,networkouvolume.commandeindique la tâche à effectuer par le démon, c'est-à-dire la commanderun.optionspeut être n'importe quel paramètre valide qui peut remplacer le comportement par défaut de la commande, comme l'option--publishpour le mappage de port.

Maintenant, en suivant cette syntaxe, la commande run peut être écrite comme suit :

docker container run <nom de l'image>

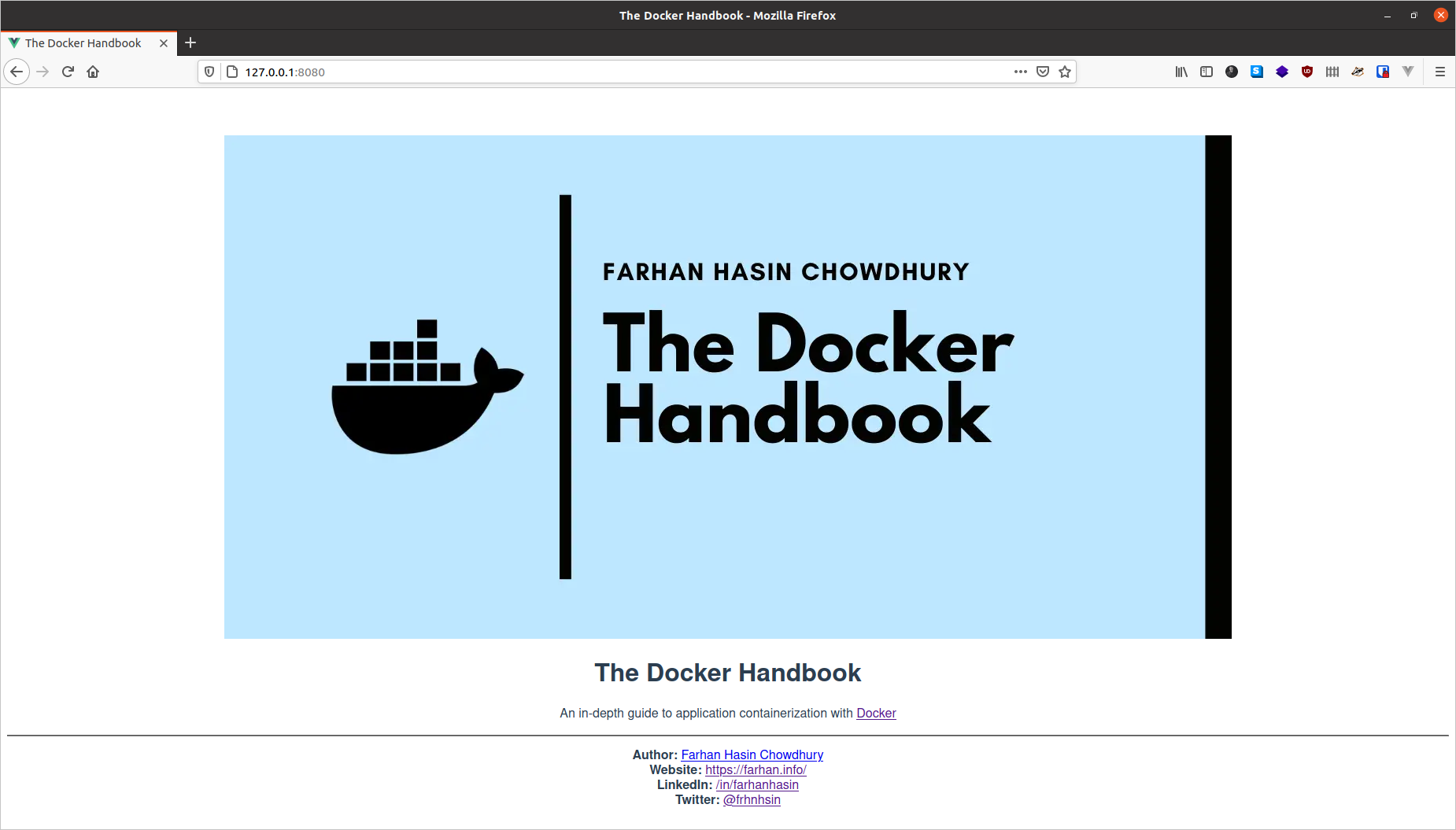

Le nom de l'image peut être celui de n'importe quelle image d'un registre en ligne ou de votre système local. Par exemple, vous pouvez essayer d'exécuter un conteneur en utilisant l'image fhsinchy/hello-dock. Cette image contient une simple application Vue.js qui s'exécute sur le port 80 à l'intérieur du conteneur.

Pour exécuter un conteneur en utilisant cette image, exécutez la commande suivante sur votre terminal :

docker container run --publish 8080:80 fhsinchy/hello-dock

# /docker-entrypoint.sh: /docker-entrypoint.d/ is not empty, will attempt to perform configuration

# /docker-entrypoint.sh: Looking for shell scripts in /docker-entrypoint.d/

# /docker-entrypoint.sh: Launching /docker-entrypoint.d/10-listen-on-ipv6-by-default.sh

# 10-listen-on-ipv6-by-default.sh: Getting the checksum of /etc/nginx/conf.d/default.conf

# 10-listen-on-ipv6-by-default.sh: Enabled listen on IPv6 in /etc/nginx/conf.d/default.conf

# /docker-entrypoint.sh: Launching /docker-entrypoint.d/20-envsubst-on-templates.sh

# /docker-entrypoint.sh: Configuration complete; ready for start up

La commande est assez explicite. La seule partie qui peut nécessiter une explication est la partie --publish 8080:80 qui sera expliquée dans la sous-section suivante.

Comment publier un port

Les conteneurs sont des environnements isolés. Votre système hôte ne sait rien de ce qui se passe à l'intérieur d'un conteneur. Par conséquent, les applications s'exécutant à l'intérieur d'un conteneur restent inaccessibles depuis l'extérieur.

Pour permettre l'accès depuis l'extérieur d'un conteneur, vous devez publier le port approprié à l'intérieur du conteneur vers un port sur votre réseau local. La syntaxe courante pour l'option --publish ou -p est la suivante :

--publish <port hôte>:<port conteneur>

Lorsque vous avez écrit --publish 8080:80 dans la sous-section précédente, cela signifiait que toute requête envoyée au port 8080 de votre système hôte sera transférée au port 80 à l'intérieur du conteneur.

Maintenant, pour accéder à l'application sur votre navigateur, visitez http://127.0.0.1:8080.

Vous pouvez arrêter le conteneur en appuyant simplement sur la combinaison de touches ctrl + c lorsque la fenêtre du terminal est en focus ou en fermant complètement la fenêtre du terminal.

Comment utiliser le mode détaché

Une autre option très populaire de la commande run est l'option --detach ou -d. Dans l'exemple ci-dessus, pour que le conteneur continue de s'exécuter, vous deviez garder la fenêtre du terminal ouverte. La fermeture de la fenêtre du terminal a également arrêté le conteneur en cours d'exécution.

Cela est dû au fait que, par défaut, les conteneurs s'exécutent au premier plan et s'attachent au terminal comme tout autre programme normal invoqué depuis le terminal.

Afin de remplacer ce comportement et de garder un conteneur en cours d'exécution en arrière-plan, vous pouvez inclure l'option --detach avec la commande run comme suit :

docker container run --detach --publish 8080:80 fhsinchy/hello-dock

# 9f21cb77705810797c4b847dbd330d9c732ffddba14fb435470567a7a3f46cdc

Contrairement à l'exemple précédent, vous n'obtiendrez pas un mur de texte cette fois-ci. Au lieu de cela, ce que vous obtiendrez, c'est l'ID du conteneur nouvellement créé.

L'ordre des options que vous fournissez n'a pas vraiment d'importance. Si vous mettez l'option --publish avant l'option --detach, cela fonctionnera de la même manière. Une chose que vous devez garder à l'esprit dans le cas de la commande run est que le nom de l'image doit venir en dernier. Si vous mettez quoi que ce soit après le nom de l'image, cela sera passé comme argument au point d'entrée du conteneur (expliqué dans la sous-section Exécuter des commandes à l'intérieur d'un conteneur) et peut entraîner des situations inattendues.

Comment lister les conteneurs

La commande container ls peut être utilisée pour lister les conteneurs qui sont actuellement en cours d'exécution. Pour ce faire, exécutez la commande suivante :

docker container ls

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# 9f21cb777058 fhsinchy/hello-dock "/docker-entrypoint." 5 seconds ago Up 5 seconds 0.0.0.0:8080->80/tcp gifted_sammet

Un conteneur nommé gifted_sammet est en cours d'exécution. Il a été créé il y a 5 secondes et le statut est Up 5 seconds, ce qui indique que le conteneur fonctionne correctement depuis sa création.

Le CONTAINER ID est 9f21cb777058 qui est les 12 premiers caractères de l'ID complet du conteneur. L'ID complet du conteneur est 9f21cb77705810797c4b847dbd330d9c732ffddba14fb435470567a7a3f46cdc qui fait 64 caractères de long. Cet ID complet du conteneur a été imprimé comme résultat de la commande docker container run dans la section précédente.

Listé sous la colonne PORTS, le port 8080 de votre réseau local pointe vers le port 80 à l'intérieur du conteneur. Le nom gifted_sammet est généré par Docker et peut être quelque chose de complètement différent sur votre ordinateur.

La commande container ls ne liste que les conteneurs qui sont actuellement en cours d'exécution sur votre système. Afin de lister les conteneurs qui ont été exécutés dans le passé, vous pouvez utiliser l'option --all ou -a.

docker container ls --all

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# 9f21cb777058 fhsinchy/hello-dock "/docker-entrypoint." 2 minutes ago Up 2 minutes 0.0.0.0:8080->80/tcp gifted_sammet

# 6cf52771dde1 fhsinchy/hello-dock "/docker-entrypoint." 3 minutes ago Exited (0) 3 minutes ago reverent_torvalds

# 128ec8ceab71 hello-world "/hello" 4 minutes ago Exited (0) 4 minutes ago exciting_chebyshev

Comme vous pouvez le voir, le deuxième conteneur de la liste reverent_torvalds a été créé plus tôt et a quitté avec le code de statut 0, ce qui indique qu'aucune erreur n'a été produite pendant l'exécution du conteneur.

Comment nommer ou renommer un conteneur

Par défaut, chaque conteneur a deux identifiants. Ils sont les suivants :

CONTAINER ID- une chaîne aléatoire de 64 caractères.NAME- combinaison de deux mots aléatoires, joints par un trait de soulignement.

Faire référence à un conteneur basé sur ces deux identifiants aléatoires est un peu gênant. Ce serait bien si les conteneurs pouvaient être référencés en utilisant un nom défini par vous.

Le fait de nommer un conteneur peut être réalisé en utilisant l'option --name. Pour exécuter un autre conteneur en utilisant l'image fhsinchy/hello-dock avec le nom hello-dock-container, vous pouvez exécuter la commande suivante :

docker container run --detach --publish 8888:80 --name hello-dock-container fhsinchy/hello-dock

# b1db06e400c4c5e81a93a64d30acc1bf821bed63af36cab5cdb95d25e114f5fb

Le port 8080 sur le réseau local est occupé par le conteneur gifted_sammet (le conteneur créé dans la sous-section précédente). C'est pourquoi vous devrez utiliser un numéro de port différent, comme 8888. Maintenant, pour vérifier, exécutez la commande container ls :

docker container ls

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# b1db06e400c4 fhsinchy/hello-dock "/docker-entrypoint." 28 seconds ago Up 26 seconds 0.0.0.0:8888->80/tcp hello-dock-container

# 9f21cb777058 fhsinchy/hello-dock "/docker-entrypoint." 4 minutes ago Up 4 minutes 0.0.0.0:8080->80/tcp gifted_sammet

Un nouveau conteneur avec le nom hello-dock-container a été démarré.

Vous pouvez même renommer les anciens conteneurs en utilisant la commande container rename. La syntaxe de la commande est la suivante :

docker container rename <identifiant du conteneur> <nouveau nom>

Pour renommer le conteneur gifted_sammet en hello-dock-container-2, exécutez la commande suivante :

docker container rename gifted_sammet hello-dock-container-2

La commande ne produit aucune sortie, mais vous pouvez vérifier que les changements ont eu lieu en utilisant la commande container ls. La commande rename fonctionne pour les conteneurs à la fois en état d'exécution et à l'état arrêté.

Comment arrêter ou tuer un conteneur en cours d'exécution

Les conteneurs s'exécutant au premier plan peuvent être arrêtés en fermant simplement la fenêtre du terminal ou en appuyant sur ctrl + c. Les conteneurs s'exécutant en arrière-plan, cependant, ne peuvent pas être arrêtés de la même manière.

Il existe deux commandes qui traitent de cette tâche. La première est la commande container stop. La syntaxe générique de la commande est la suivante :

docker container stop <identifiant du conteneur>

Où identifiant du conteneur peut être soit l'ID soit le nom du conteneur.

J'espère que vous vous souvenez du conteneur que vous avez démarré dans la section précédente. Il est toujours en cours d'exécution en arrière-plan. Obtenez l'identifiant de ce conteneur en utilisant docker container ls (j'utiliserai le conteneur hello-dock-container pour cette démonstration). Maintenant, exécutez la commande suivante pour arrêter le conteneur :

docker container stop hello-dock-container

# hello-dock-container

Si vous utilisez le nom comme identifiant, vous obtiendrez le nom renvoyé comme sortie. La commande stop arrête un conteneur de manière élégante en envoyant un signal SIGTERM. Si le conteneur ne s'arrête pas dans un certain délai, un signal SIGKILL est envoyé, ce qui arrête immédiatement le conteneur.

Dans les cas où vous souhaitez envoyer un signal SIGKILL au lieu d'un signal SIGTERM, vous pouvez utiliser la commande container kill à la place. La commande container kill suit la même syntaxe que la commande stop.

docker container kill hello-dock-container-2

# hello-dock-container-2

Comment redémarrer un conteneur

Lorsque je dis redémarrer, je veux dire deux scénarios spécifiques. Ils sont les suivants :

- Redémarrer un conteneur qui a été précédemment arrêté ou tué.

- Redémarrer un conteneur en cours d'exécution.

Comme vous l'avez déjà appris dans une sous-section précédente, les conteneurs arrêtés restent dans votre système. Si vous le souhaitez, vous pouvez les redémarrer. La commande container start peut être utilisée pour démarrer n'importe quel conteneur arrêté ou tué. La syntaxe de la commande est la suivante :

docker container start <identifiant du conteneur>

Vous pouvez obtenir la liste de tous les conteneurs en exécutant la commande container ls --all. Ensuite, recherchez les conteneurs avec le statut Exited.

docker container ls --all

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# b1db06e400c4 fhsinchy/hello-dock "/docker-entrypoint." 3 minutes ago Exited (0) 47 seconds ago hello-dock-container

# 9f21cb777058 fhsinchy/hello-dock "/docker-entrypoint." 7 minutes ago Exited (137) 17 seconds ago hello-dock-container-2

# 6cf52771dde1 fhsinchy/hello-dock "/docker-entrypoint." 7 minutes ago Exited (0) 7 minutes ago reverent_torvalds

# 128ec8ceab71 hello-world "/hello" 9 minutes ago Exited (0) 9 minutes ago exciting_chebyshev

Maintenant, pour redémarrer le conteneur hello-dock-container, vous pouvez exécuter la commande suivante :

docker container start hello-dock-container

# hello-dock-container

Maintenant, vous pouvez vous assurer que le conteneur est en cours d'exécution en regardant la liste des conteneurs en cours d'exécution en utilisant la commande container ls.

La commande container start démarre tout conteneur en mode détaché par défaut et conserve toute configuration de port effectuée précédemment. Donc si vous visitez http://127.0.0.1:8080 maintenant, vous devriez pouvoir accéder à l'application hello-dock comme avant.

Maintenant, dans les scénarios où vous souhaitez redémarrer un conteneur en cours d'exécution, vous pouvez utiliser la commande container restart. La commande container restart suit la syntaxe exacte de la commande container start.

docker container restart hello-dock-container-2

# hello-dock-container-2

La principale différence entre les deux commandes est que la commande container restart tente d'arrêter le conteneur cible puis le redémarre, alors que la commande start démarre simplement un conteneur déjà arrêté.

Dans le cas d'un conteneur arrêté, les deux commandes sont exactement les mêmes. Mais dans le cas d'un conteneur en cours d'exécution, vous devez utiliser la commande container restart.

Comment créer un conteneur sans l'exécuter

Jusqu'à présent dans cette section, vous avez démarré des conteneurs en utilisant la commande container run qui est en réalité une combinaison de deux commandes séparées. Ces commandes sont les suivantes :

- La commande

container createcrée un conteneur à partir d'une image donnée. - La commande

container startdémarre un conteneur qui a déjà été créé.

Maintenant, pour effectuer la démonstration montrée dans la section "Comment exécuter un conteneur" en utilisant ces deux commandes, vous pouvez faire quelque chose comme ce qui suit :

docker container create --publish 8080:80 fhsinchy/hello-dock

# 2e7ef5098bab92f4536eb9a372d9b99ed852a9a816c341127399f51a6d053856

docker container ls --all

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# 2e7ef5098bab fhsinchy/hello-dock "/docker-entrypoint." 30 seconds ago Created hello-dock

Comme le montre la sortie de la commande container ls --all, un conteneur nommé hello-dock a été créé en utilisant l'image fhsinchy/hello-dock. Le STATUS du conteneur est Created pour le moment, et, étant donné qu'il ne s'exécute pas, il ne sera pas listé sans l'utilisation de l'option --all.

Une fois le conteneur créé, il peut être démarré en utilisant la commande container start.

docker container start hello-dock

# hello-dock

docker container ls

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# 2e7ef5098bab fhsinchy/hello-dock "/docker-entrypoint." About a minute ago Up 29 seconds 0.0.0.0:8080->80/tcp hello-dock

Le STATUS du conteneur est passé de Created à Up 29 seconds, ce qui indique que le conteneur est maintenant en état d'exécution. La configuration du port a également été affichée dans la colonne PORTS, qui était précédemment vide.

Bien que vous puissiez vous en sortir avec la commande container run pour la majorité des scénarios, il y aura certaines situations plus tard dans le livre qui nécessiteront l'utilisation de cette commande container create.

Comment supprimer les conteneurs suspendus

Comme vous l'avez déjà vu, les conteneurs qui ont été arrêtés ou tués restent dans le système. Ces conteneurs suspendus peuvent prendre de la place ou entrer en conflit avec de nouveaux conteneurs.

Afin de supprimer un conteneur arrêté, vous pouvez utiliser la commande container rm. La syntaxe générique est la suivante :

docker container rm <identifiant du conteneur>

Pour savoir quels conteneurs ne sont pas en cours d'exécution, utilisez la commande container ls --all et recherchez les conteneurs avec le statut Exited.

docker container ls --all

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# b1db06e400c4 fhsinchy/hello-dock "/docker-entrypoint." 6 minutes ago Up About a minute 0.0.0.0:8888->80/tcp hello-dock-container

# 9f21cb777058 fhsinchy/hello-dock "/docker-entrypoint." 10 minutes ago Up About a minute 0.0.0.0:8080->80/tcp hello-dock-container-2

# 6cf52771dde1 fhsinchy/hello-dock "/docker-entrypoint." 10 minutes ago Exited (0) 10 minutes ago reverent_torvalds

# 128ec8ceab71 hello-world "/hello" 12 minutes ago Exited (0) 12 minutes ago exciting_chebyshev

Comme on peut le voir dans la sortie, les conteneurs avec l'ID 6cf52771dde1 et 128ec8ceab71 ne sont pas en cours d'exécution. Pour supprimer le 6cf52771dde1, vous pouvez exécuter la commande suivante :

docker container rm 6cf52771dde1

# 6cf52771dde1

Vous pouvez vérifier si le conteneur a été supprimé ou non en utilisant la commande container ls. Vous pouvez également supprimer plusieurs conteneurs à la fois en passant leurs identifiants les uns après les autres, séparés par des espaces.

Ou, au lieu de supprimer des conteneurs individuels, si vous souhaitez supprimer tous les conteneurs suspendus en une seule fois, vous pouvez utiliser la commande container prune.

Vous pouvez vérifier la liste des conteneurs en utilisant la commande container ls --all pour vous assurer que les conteneurs suspendus ont été supprimés :

docker container ls --all

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# b1db06e400c4 fhsinchy/hello-dock "/docker-entrypoint." 8 minutes ago Up 3 minutes 0.0.0.0:8888->80/tcp hello-dock-container

# 9f21cb777058 fhsinchy/hello-dock "/docker-entrypoint." 12 minutes ago Up 3 minutes 0.0.0.0:8080->80/tcp hello-dock-container-2

Si vous suivez le livre exactement comme écrit jusqu'à présent, vous devriez seulement voir hello-dock-container et hello-dock-container-2 dans la liste. Je vous suggère d'arrêter et de supprimer les deux conteneurs avant de passer à la section suivante.

Il y a aussi l'option --rm pour les commandes container run et container start qui indique que vous voulez que les conteneurs soient supprimés dès qu'ils sont arrêtés. Pour démarrer un autre conteneur hello-dock avec l'option --rm, exécutez la commande suivante :

docker container run --rm --detach --publish 8888:80 --name hello-dock-volatile fhsinchy/hello-dock

# 0d74e14091dc6262732bee226d95702c21894678efb4043663f7911c53fb79f3

Vous pouvez utiliser la commande container ls pour vérifier que le conteneur est en cours d'exécution :

docker container ls

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# 0d74e14091dc fhsinchy/hello-dock "/docker-entrypoint." About a minute ago Up About a minute 0.0.0.0:8888->80/tcp hello-dock-volatile

Maintenant, si vous arrêtez le conteneur et vérifiez à nouveau avec la commande container ls --all :

docker container stop hello-dock-volatile

# hello-dock-volatile

docker container ls --all

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

Le conteneur a été supprimé automatiquement. À partir de maintenant, j'utiliserai l'option --rm pour la plupart des conteneurs. Je mentionnerai explicitement où elle n'est pas nécessaire.

Comment exécuter un conteneur en mode interactif

Jusqu'à présent, vous n'avez exécuté que des conteneurs créés à partir de l'image hello-world ou de l'image fhsinchy/hello-dock. Ces images sont conçues pour exécuter des programmes simples qui ne sont pas interactifs.

Eh bien, toutes les images ne sont pas aussi simples. Les images peuvent encapsuler une distribution Linux entière.

Les distributions populaires telles que Ubuntu, Fedora, et Debian ont toutes des images Docker officielles disponibles dans le hub. Les langages de programmation tels que python, php, go ou les environnements d'exécution comme node et deno ont tous leurs images officielles.

Ces images ne se contentent pas d'exécuter un programme préconfiguré. Elles sont plutôt configurées pour exécuter un shell par défaut. Dans le cas des images de système d'exploitation, il peut s'agir de quelque chose comme sh ou bash, et dans le cas des langages de programmation ou des environnements d'exécution, il s'agit généralement de leur shell de langage par défaut.

Comme vous l'avez peut-être déjà appris de vos expériences précédentes avec les ordinateurs, les shells sont des programmes interactifs. Une image configurée pour exécuter un tel programme est une image interactive. Ces images nécessitent une option spéciale -it à passer dans la commande container run.

Par exemple, si vous exécutez un conteneur en utilisant l'image ubuntu en exécutant docker container run ubuntu, vous verrez que rien ne se passe. Mais si vous exécutez la même commande avec l'option -it, vous devriez atterrir directement sur bash à l'intérieur du conteneur Ubuntu.

docker container run --rm -it ubuntu

# root@dbb1f56b9563:/# cat /etc/os-release

# NAME="Ubuntu"

# VERSION="20.04.1 LTS (Focal Fossa)"

# ID=ubuntu

# ID_LIKE=debian

# PRETTY_NAME="Ubuntu 20.04.1 LTS"

# VERSION_ID="20.04"

# HOME_URL="https://www.ubuntu.com/"

# SUPPORT_URL="https://help.ubuntu.com/"

# BUG_REPORT_URL="https://bugs.launchpad.net/ubuntu/"

# PRIVACY_POLICY_URL="https://www.ubuntu.com/legal/terms-and-policies/privacy-policy"

# VERSION_CODENAME=focal

# UBUNTU_CODENAME=focal

Comme vous pouvez le voir à partir de la sortie de la commande cat /etc/os-release, je suis effectivement en interaction avec le bash s'exécutant à l'intérieur du conteneur Ubuntu.

L'option -it prépare le terrain pour que vous puissiez interagir avec tout programme interactif à l'intérieur d'un conteneur. Cette option est en fait deux options séparées combinées.

- L'option

-iou--interactivevous connecte au flux d'entrée du conteneur, afin que vous puissiez envoyer des entrées à bash. - L'option

-tou--ttygarantit que vous obtenez un bon formatage et une expérience de type terminal natif en allouant un pseudo-tty.

Vous devez utiliser l'option -it chaque fois que vous souhaitez exécuter un conteneur en mode interactif. Un autre exemple peut être l'exécution de l'image node comme suit :

docker container run -it node

# Welcome to Node.js v15.0.0.

# Type ".help" for more information.

# > ['farhan', 'hasin', 'chowdhury'].map(name => name.toUpperCase())

# [ 'FARHAN', 'HASIN', 'CHOWDHURY' ]

Tout code JavaScript valide peut être exécuté dans le shell node. Au lieu d'écrire -it, vous pouvez être plus verbeux en écrivant --interactive --tty séparément.

Comment exécuter des commandes à l'intérieur d'un conteneur

Dans la section Hello World dans Docker de ce livre, vous m'avez vu exécuter une commande à l'intérieur d'un conteneur Alpine Linux. Cela s'est passé comme suit :

docker run alpine uname -a

# Linux f08dbbe9199b 5.8.0-22-generic #23-Ubuntu SMP Fri Oct 9 00:34:40 UTC 2020 x86_64 Linux

Dans cette commande, j'ai exécuté la commande uname -a à l'intérieur d'un conteneur Alpine Linux. Des scénarios comme celui-ci (où tout ce que vous voulez faire est d'exécuter une certaine commande à l'intérieur d'un certain conteneur) sont assez courants.

Supposons que vous souhaitez encoder une chaîne en utilisant le programme base64. C'est quelque chose qui est disponible dans presque tous les systèmes d'exploitation basés sur Linux ou Unix (mais pas sur Windows).

Dans cette situation, vous pouvez rapidement lancer un conteneur en utilisant des images comme busybox et le laisser faire le travail.

La syntaxe générique pour encoder une chaîne en utilisant base64 est la suivante :

echo -n my-secret | base64

# bXktc2VjcmV0

Et la syntaxe générique pour passer une commande à un conteneur qui n'est pas en cours d'exécution est la suivante :

docker container run <nom de l'image> <commande>

Pour effectuer l'encodage base64 en utilisant l'image busybox, vous pouvez exécuter la commande suivante :

docker container run --rm busybox sh -c "echo -n my-secret | base64

# bXktc2VjcmV0

Ce qui se passe ici, c'est que dans une commande container run, tout ce que vous passez après le nom de l'image est transmis au point d'entrée par défaut de l'image.

Un point d'entrée est comme une passerelle vers l'image. La plupart des images, à l'exception des images exécutables (expliquées dans la sous-section Travailler avec des images exécutables), utilisent le shell ou sh comme point d'entrée par défaut. Ainsi, toute commande shell valide peut leur être passée comme arguments.

Comment travailler avec des images exécutables

Dans la section précédente, j'ai brièvement mentionné les images exécutables. Ces images sont conçues pour se comporter comme des programmes exécutables.

Prenons par exemple mon projet rmbyext. Il s'agit d'un simple script Python capable de supprimer récursivement des fichiers d'extensions données. Pour en savoir plus sur le projet, vous pouvez consulter le dépôt :

Si vous avez à la fois Git et Python installés, vous pouvez installer ce script en exécutant la commande suivante :

pip install git+https://github.com/fhsinchy/rmbyext.git#egg=rmbyext

En supposant que Python a été correctement configuré sur votre système, le script devrait être disponible partout via le terminal. La syntaxe générique pour utiliser ce script est la suivante :

rmbyext <extension de fichier>

Pour le tester, ouvrez votre terminal dans un répertoire vide et créez quelques fichiers avec différentes extensions. Vous pouvez utiliser la commande touch pour ce faire. Maintenant, j'ai un répertoire sur mon ordinateur avec les fichiers suivants :

touch a.pdf b.pdf c.txt d.pdf e.txt

ls

# a.pdf b.pdf c.txt d.pdf e.txt

Pour supprimer tous les fichiers pdf de ce répertoire, vous pouvez exécuter la commande suivante :

rmbyext pdf

# Removing: PDF

# b.pdf

# a.pdf

# d.pdf

Une image exécutable pour ce programme devrait être capable de prendre des extensions de fichiers comme arguments et de les supprimer comme le programme rmbyext l'a fait.

L'image fhsinchy/rmbyext se comporte de manière similaire. Cette image contient une copie du script rmbyext et est configurée pour exécuter le script sur un répertoire /zone à l'intérieur du conteneur.

Maintenant, le problème est que les conteneurs sont isolés de votre système local, donc le programme rmbyext s'exécutant à l'intérieur du conteneur n'a aucun accès à votre système de fichiers local. Donc, si d'une manière ou d'une autre vous pouvez mapper le répertoire local contenant les fichiers pdf au répertoire /zone à l'intérieur du conteneur, les fichiers devraient être accessibles au conteneur.

Une façon de donner à un conteneur un accès direct à votre système de fichiers local est d'utiliser des montages de liaison.

Un montage de liaison vous permet de former une liaison de données bidirectionnelle entre le contenu d'un répertoire du système de fichiers local (source) et un autre répertoire à l'intérieur d'un conteneur (destination). De cette manière, toute modification apportée dans le répertoire de destination aura un effet sur le répertoire source et vice versa.

Voyons un montage de liaison en action. Pour supprimer des fichiers en utilisant cette image au lieu du programme lui-même, vous pouvez exécuter la commande suivante :

docker container run --rm -v $(pwd):/zone fhsinchy/rmbyext pdf

# Removing: PDF

# b.pdf

# a.pdf

# d.pdf

Comme vous l'avez peut-être déjà deviné en voyant la partie -v $(pwd):/zone dans la commande, l'option -v ou --volume est utilisée pour créer un montage de liaison pour un conteneur. Cette option peut prendre trois champs séparés par des deux-points (:). La syntaxe générique de l'option est la suivante :

--volume <chemin absolu du répertoire du système de fichiers local>:<chemin absolu du répertoire du système de fichiers du conteneur>:<accès en lecture-écriture>

Le troisième champ est facultatif, mais vous devez passer le chemin absolu de votre répertoire local et le chemin absolu du répertoire à l'intérieur du conteneur.

Le répertoire source dans mon cas est /home/fhsinchy/the-zone. Étant donné que mon terminal est ouvert à l'intérieur du répertoire, $(pwd) sera remplacé par /home/fhsinchy/the-zone qui contient les fichiers .pdf et .txt mentionnés précédemment.

Vous pouvez en savoir plus sur la substitution de commande ici si vous le souhaitez.

L'option --volume ou -v est valable pour les commandes container run ainsi que pour les commandes container create. Nous explorerons les volumes plus en détail dans les sections à venir, donc ne vous inquiétez pas si vous ne les avez pas très bien compris ici.

La différence entre une image régulière et une image exécutable est que le point d'entrée d'une image exécutable est défini sur un programme personnalisé au lieu de sh, dans ce cas, le programme rmbyext. Et comme vous l'avez appris dans la sous-section précédente, tout ce que vous écrivez après le nom de l'image dans une commande container run est passé au point d'entrée de l'image.

Ainsi, à la fin, la commande docker container run --rm -v $(pwd):/zone fhsinchy/rmbyext pdf se traduit par rmbyext pdf à l'intérieur du conteneur. Les images exécutables ne sont pas si courantes dans la nature, mais peuvent être très utiles dans certains cas.

Bases de la manipulation des images Docker

Maintenant que vous avez une solide compréhension de l'exécution des conteneurs en utilisant des images publiquement disponibles, il est temps pour vous d'apprendre à créer vos propres images.

Dans cette section, vous apprendrez les bases de la création d'images, de l'exécution de conteneurs en les utilisant, et de leur partage en ligne.

Je vous suggère d'installer Visual Studio Code avec l'extension officielle Docker Extension depuis le marketplace. Cela améliorera grandement votre expérience de développement.

Comment créer une image Docker

Comme je l'ai déjà expliqué dans la section Hello World dans Docker, les images sont des fichiers autonomes à plusieurs couches qui servent de modèle pour la création de conteneurs Docker. Elles sont comme une copie gelée et en lecture seule d'un conteneur.

Afin de créer une image en utilisant l'un de vos programmes, vous devez avoir une vision claire de ce que vous voulez de l'image. Prenez l'image officielle nginx, par exemple. Vous pouvez démarrer un conteneur en utilisant cette image simplement en exécutant la commande suivante :

docker container run --rm --detach --name default-nginx --publish 8080:80 nginx

# b379ecd5b6b9ae27c144e4fa12bdc5d0635543666f75c14039eea8d5f38e3f56

docker container ls

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# b379ecd5b6b9 nginx "/docker-entrypoint." 8 seconds ago Up 8 seconds 0.0.0.0:8080->80/tcp default-nginx

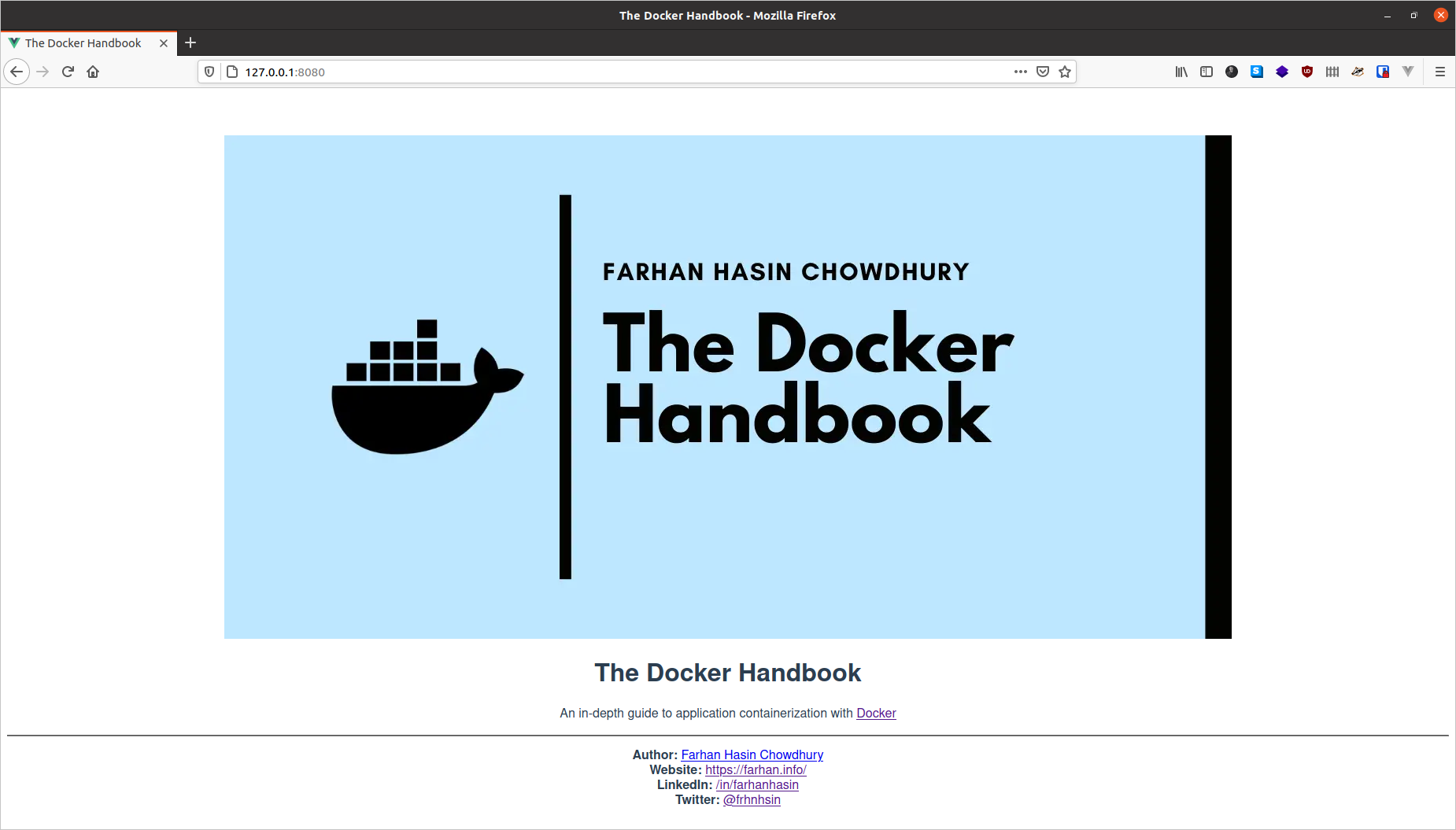

Maintenant, si vous visitez http://127.0.0.1:8080 dans le navigateur, vous verrez une page de réponse par défaut.

C'est bien et bon, mais que faire si vous voulez créer une image NGINX personnalisée qui fonctionne exactement comme l'officielle, mais qui est construite par vous ? C'est un scénario complètement valide, à vrai dire. En fait, faisons cela.

Afin de créer une image NGINX personnalisée, vous devez avoir une image claire de l'état final de l'image. À mon avis, l'image devrait être comme suit :

- L'image doit avoir NGINX préinstallé, ce qui peut être fait en utilisant un gestionnaire de paquets ou peut être construit à partir de la source.

- L'image doit démarrer NGINX automatiquement lors de l'exécution.

C'est simple. Si vous avez cloné le dépôt du projet lié dans ce livre, allez à l'intérieur de la racine du projet et cherchez un répertoire nommé custom-nginx.

Maintenant, créez un nouveau fichier nommé Dockerfile à l'intérieur de ce répertoire. Un Dockerfile est une collection d'instructions qui, une fois traitées par le démon, résultent en une image. Le contenu du Dockerfile est le suivant :

FROM ubuntu:latest

EXPOSE 80

RUN apt-get update && \

apt-get install nginx -y && \

apt-get clean && rm -rf /var/lib/apt/lists/*

CMD ["nginx", "-g", "daemon off;"]

Les images sont des fichiers à plusieurs couches et dans ce fichier, chaque ligne (appelée instructions) que vous avez écrite crée une couche pour votre image.

- Chaque

Dockerfilevalide commence par une instructionFROM. Cette instruction définit l'image de base pour votre image résultante. En définissantubuntu:latestcomme image de base ici, vous obtenez toutes les fonctionnalités d'Ubuntu déjà disponibles dans votre image personnalisée, afin que vous puissiez utiliser des choses comme la commandeapt-getpour une installation facile des paquets. - L'instruction

EXPOSEest utilisée pour indiquer le port qui doit être publié. L'utilisation de cette instruction ne signifie pas que vous n'aurez pas besoin de--publishle port. Vous devrez toujours utiliser l'option--publishexplicitement. Cette instructionEXPOSEfonctionne comme une documentation pour quelqu'un qui essaie d'exécuter un conteneur en utilisant votre image. Elle a également d'autres utilisations que je ne discuterai pas ici. - L'instruction

RUNdans unDockerfileexécute une commande à l'intérieur du shell du conteneur. La commandeapt-get update && apt-get install nginx -yvérifie les versions mises à jour des paquets et installe NGINX. La commandeapt-get clean && rm -rf /var/lib/apt/lists/*est utilisée pour effacer le cache des paquets car vous ne voulez pas de bagages inutiles dans votre image. Ces deux commandes sont des trucs Ubuntu simples, rien de fantaisiste. Les instructionsRUNici sont écrites sous formeshell. Elles peuvent également être écrites sous formeexec. Vous pouvez consulter la référence officielle pour plus d'informations. - Enfin, l'instruction

CMDdéfinit la commande par défaut pour votre image. Cette instruction est écrite sous formeexecici, composée de trois parties distinctes. Ici,nginxfait référence à l'exécutable NGINX. Les options-getdaemon offsont des options pour NGINX. L'exécution de NGINX en tant que processus unique à l'intérieur des conteneurs est considérée comme une meilleure pratique, d'où l'utilisation de cette option. L'instructionCMDpeut également être écrite sous formeshell. Vous pouvez consulter la référence officielle pour plus d'informations.

Maintenant que vous avez un Dockerfile valide, vous pouvez construire une image à partir de celui-ci. Tout comme les commandes liées aux conteneurs, les commandes liées aux images peuvent être émises en utilisant la syntaxe suivante :

docker image <commande> <options>

Pour construire une image en utilisant le Dockerfile que vous venez d'écrire, ouvrez votre terminal à l'intérieur du répertoire custom-nginx et exécutez la commande suivante :

docker image build .

# Sending build context to Docker daemon 3.584kB

# Step 1/4 : FROM ubuntu:latest

# ---> d70eaf7277ea

# Step 2/4 : EXPOSE 80

# ---> Running in 9eae86582ec7

# Removing intermediate container 9eae86582ec7

# ---> 8235bd799a56

# Step 3/4 : RUN apt-get update && apt-get install nginx -y && apt-get clean && rm -rf /var/lib/apt/lists/*

# ---> Running in a44725cbb3fa

### LONG INSTALLATION STUFF GOES HERE ###

# Removing intermediate container a44725cbb3fa

# ---> 3066bd20292d

# Step 4/4 : CMD ["nginx", "-g", "daemon off;"]

# ---> Running in 4792e4691660

# Removing intermediate container 4792e4691660

# ---> 3199372aa3fc

# Successfully built 3199372aa3fc

Pour effectuer une construction d'image, le démon a besoin de deux informations très spécifiques. Il s'agit du nom du Dockerfile et du contexte de construction. Dans la commande émise ci-dessus :

docker image buildest la commande pour construire l'image. Le démon trouve tout fichier nomméDockerfiledans le contexte.- Le

.à la fin définit le contexte pour cette construction. Le contexte signifie le répertoire accessible par le démon pendant le processus de construction.

Maintenant, pour exécuter un conteneur en utilisant cette image, vous pouvez utiliser la commande container run couplée avec l'ID de l'image que vous avez reçu comme résultat du processus de construction. Dans mon cas, l'ID est 3199372aa3fc, comme en témoigne la ligne Successfully built 3199372aa3fc dans le bloc de code précédent.

docker container run --rm --detach --name custom-nginx-packaged --publish 8080:80 3199372aa3fc

# ec09d4e1f70c903c3b954c8d7958421cdd1ae3d079b57f929e44131fbf8069a0

docker container ls

# CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

# ec09d4e1f70c 3199372aa3fc "nginx -g 'daemon of" 23 seconds ago Up 22 seconds 0.0.0.0:8080->80/tcp custom-nginx-packaged

Pour vérifier, visitez http://127.0.0.1:8080 et vous devriez voir la page de réponse par défaut.

Comment étiqueter les images Docker

Tout comme les conteneurs, vous pouvez attribuer des identifiants personnalisés à vos images au lieu de vous fier à l'ID généré aléatoirement. Dans le cas d'une image, on parle d'étiquetage plutôt que de nommage. L'option --tag ou -t est utilisée dans de tels cas.

La syntaxe générique de l'option est la suivante :

--tag <dépôt d'image>:<étiquette d'image>

Le dépôt est généralement connu sous le nom de nom de l'image et l'étiquette indique une certaine version ou build.

Prenons l'image officielle mysql, par exemple. Si vous souhaitez exécuter un conteneur en utilisant une version spécifique de MySQL, comme 5.7, vous pouvez exécuter docker container run mysql:5.7 où mysql est le dépôt de l'image et 5.7 est l'étiquette.

Afin d'étiqueter votre image NGINX personnalisée avec custom-nginx:packaged, vous pouvez exécuter la commande suivante :

docker image build --tag custom-nginx:packaged .

# Sending build context to Docker daemon 1.055MB

# Step 1/4 : FROM ubuntu:latest

# ---> f63181f19b2f

# Step 2/4 : EXPOSE 80

# ---> Running in 53ab370b9efc

# Removing intermediate container 53ab370b9efc

# ---> 6d6460a74447

# Step 3/4 : RUN apt-get update && apt-get install nginx -y && apt-get clean && rm -rf /var/lib/apt/lists/*

# ---> Running in b4951b6b48bb

### LONG INSTALLATION STUFF GOES HERE ###

# Removing intermediate container b4951b6b48bb

# ---> fdc6cdd8925a

# Step 4/4 : CMD ["nginx", "-g", "daemon off;"]

# ---> Running in 3bdbd2af4f0e

# Removing intermediate container 3bdbd2af4f0e

# ---> f8837621b99d

# Successfully built f8837621b99d

# Successfully tagged custom-nginx:packaged

Rien ne changera sauf le fait que vous pouvez maintenant faire référence à votre image en tant que custom-nginx:packaged au lieu d'une longue chaîne aléatoire.

Dans les cas où vous avez oublié d'étiqueter une image pendant le build, ou peut-être que vous voulez changer l'étiquette, vous pouvez utiliser la commande image tag pour faire cela :

docker image tag <id de l'image> <dépôt de l'image>:<étiquette de l'image>

## ou ##

docker image tag <dépôt de l'image>:<étiquette de l'image> <nouveau dépôt de l'image>:<nouvelle étiquette de l'image>

Comment lister et supprimer les images Docker

Tout comme la commande container ls, vous pouvez utiliser la commande image ls pour lister toutes les images de votre système local :

docker image ls

# REPOSITORY TAG IMAGE ID CREATED SIZE

# <none> <none> 3199372aa3fc 7 seconds ago 132MB

# custom-nginx packaged f8837621b99d 4 minutes ago 132MB

Les images listées ici peuvent être supprimées en utilisant la commande image rm. La syntaxe générique est la suivante :

docker image rm <identifiant de l'image>

L'identifiant peut être l'ID de l'image ou le dépôt de l'image. Si vous utilisez le dépôt, vous devrez également identifier l'étiquette. Pour supprimer l'image custom-nginx:packaged, vous pouvez exécuter la commande suivante :

docker image rm custom-nginx:packaged

# Untagged: custom-nginx:packaged

# Deleted: sha256:f8837621b99d3388a9e78d9ce49fbb773017f770eea80470fb85e0052beae242

# Deleted: sha256:fdc6cdd8925ac25b9e0ed1c8539f96ad89ba1b21793d061e2349b62dd517dadf

# Deleted: sha256:c20e4aa46615fe512a4133089a5cd66f9b7da76366c96548790d5bf865bd49c4

# Deleted: sha256:6d6460a744475a357a2b631a4098aa1862d04510f3625feb316358536fcd8641

Vous pouvez également utiliser la commande image prune pour nettoyer toutes les images suspendues non étiquetées comme suit :

docker image prune --force

# Deleted Images:

# deleted: sha256:ba9558bdf2beda81b9acc652ce4931a85f0fc7f69dbc91b4efc4561ef7378aff

# deleted: sha256:ad9cc3ff27f0d192f8fa5fadebf813537e02e6ad472f6536847c4de183c02c81

# deleted: sha256:f1e9b82068d43c1bb04ff3e4f0085b9f8903a12b27196df7f1145aa9296c85e7

# deleted: sha256:ec16024aa036172544908ec4e5f842627d04ef99ee9b8d9aaa26b9c2a4b52baa

# Total reclaimed space: 59.19MB

L'option --force ou -f saute toute question de confirmation. Vous pouvez également utiliser l'option --all ou -a pour supprimer toutes les images mises en cache dans votre registre local.

Comment comprendre les nombreuses couches d'une image Docker

Dès le début de ce livre, j'ai dit que les images sont des fichiers à plusieurs couches. Dans cette sous-section, je vais démontrer les différentes couches d'une image et comment elles jouent un rôle important dans le processus de construction de cette image.

Pour cette démonstration, j'utiliserai l'image custom-nginx:packaged de la sous-section précédente.

Pour visualiser les nombreuses couches d'une image, vous pouvez utiliser la commande image history. Les différentes couches de l'image custom-nginx:packaged peuvent être visualisées comme suit :

docker image history custom-nginx:packaged

# IMAGE CREATED CREATED BY SIZE COMMENT

# 7f16387f7307 5 minutes ago /bin/sh -c #(nop) CMD ["nginx" "-g" "daemon 0B

# 587c805fe8df 5 minutes ago /bin/sh -c apt-get update && apt-get ins 60MB

# 6fe4e51e35c1 6 minutes ago /bin/sh -c #(nop) EXPOSE 80 0B

# d70eaf7277ea 17 hours ago /bin/sh -c #(nop) CMD ["/bin/bash"] 0B

# <missing> 17 hours ago /bin/sh -c mkdir -p /run/systemd && echo 'do 7B

# <missing> 17 hours ago /bin/sh -c [ -z "$(apt-get indextargets)" ] 0B

# <missing> 17 hours ago /bin/sh -c set -xe && echo '#!/bin/sh' > / 811B

# <missing> 17 hours ago /bin/sh -c #(nop) ADD file:435d9776fdd3a1834 72.9MB

Il y a huit couches de cette image. La couche la plus haute est la plus récente et en descendant, les couches deviennent plus anciennes. La couche la plus haute est celle que vous utilisez généralement pour exécuter des conteneurs.

Maintenant, examinons de plus près les images en commençant par l'image d70eaf7277ea jusqu'à 7f16387f7307. J'ignorerai les quatre couches du bas où l'IMAGE est <missing> car elles ne nous concernent pas.

d70eaf7277eaa été créé par/bin/sh -c #(nop) CMD ["/bin/bash"]ce qui indique que le shell par défaut à l'intérieur d'Ubuntu a été chargé avec succès.6fe4e51e35c1a été créé par/bin/sh -c #(nop) EXPOSE 80qui était la deuxième instruction dans votre code.587c805fe8dfa été créé par/bin/sh -c apt-get update && apt-get install nginx -y && apt-get clean && rm -rf /var/lib/apt/lists/*qui était la troisième instruction dans votre code. Vous pouvez également voir que cette image a une taille de60MBétant donné que tous les paquets nécessaires ont été installés pendant l'exécution de cette instruction.- Enfin, la couche la plus haute

7f16387f7307a été créée par/bin/sh -c #(nop) CMD ["nginx", "-g", "daemon off;"]qui définit la commande par défaut pour cette image.

Comme vous pouvez le voir, l'image est composée de nombreuses couches en lecture seule, chacune enregistrant un nouvel ensemble de changements d'état déclenchés par certaines instructions. Lorsque vous démarrez un conteneur en utilisant une image, vous obtenez une nouvelle couche modifiable par-dessus les autres couches.

Ce phénomène de superposition qui se produit chaque fois que vous travaillez avec Docker a été rendu possible par un concept technique incroyable appelé système de fichiers union. Ici, union signifie union en théorie des ensembles. Selon Wikipedia -

Il permet aux fichiers et répertoires de systèmes de fichiers séparés, connus sous le nom de branches, d'être superposés de manière transparente, formant un seul système de fichiers cohérent. Les contenus de répertoires qui ont le même chemin au sein des branches fusionnées seront vus ensemble dans un seul répertoire fusionné, au sein du nouveau système de fichiers virtuel.

En utilisant ce concept, Docker peut éviter la duplication de données et peut utiliser les couches précédemment créées comme cache pour les constructions ultérieures. Cela entraîne des images compactes et efficaces qui peuvent être utilisées partout.

Comment construire NGINX à partir de la source

Dans la sous-section précédente, vous avez appris les instructions FROM, EXPOSE, RUN et CMD. Dans cette sous-section, vous apprendrez beaucoup plus sur d'autres instructions.

Dans cette sous-section, vous allez à nouveau créer une image NGINX personnalisée. Mais le twist est que vous allez construire NGINX à partir de la source au lieu de l'installer en utilisant un gestionnaire de paquets comme apt-get comme dans l'exemple précédent.

Pour construire NGINX à partir de la source, vous avez d'abord besoin de la source de NGINX. Si vous avez cloné mon dépôt de projets, vous verrez un fichier nommé nginx-1.19.2.tar.gz dans le répertoire custom-nginx. Vous utiliserez cette archive comme source pour construire NGINX.

Avant de plonger dans l'écriture de code, planifions d'abord le processus. Le processus de création d'image cette fois peut être fait en sept étapes. Elles sont les suivantes :

- Obtenez une bonne image de base pour construire l'application, comme ubuntu.

- Installez les dépendances de construction nécessaires sur l'image de base.

- Copiez le fichier

nginx-1.19.2.tar.gzà l'intérieur de l'image. - Extrayez le contenu de l'archive et débarrassez-vous-en.

- Configurez la construction, compilez et installez le programme en utilisant l'outil

make. - Débarrassez-vous du code source extrait.

- Exécutez l'exécutable

nginx.

Maintenant que vous avez un plan, commençons par ouvrir l'ancien Dockerfile et mettons à jour son contenu comme suit :

FROM ubuntu:latest

RUN apt-get update && \

apt-get install build-essential\

libpcre3 \

libpcre3-dev \

zlib1g \

zlib1g-dev \

libssl1.1 \

libssl-dev \

-y && \

apt-get clean && rm -rf /var/lib/apt/lists/*

COPY nginx-1.19.2.tar.gz .

RUN tar -xvf nginx-1.19.2.tar.gz && rm nginx-1.19.2.tar.gz

RUN cd nginx-1.19.2 && \

./configure \

--sbin-path=/usr/bin/nginx \

--conf-path=/etc/nginx/nginx.conf \

--error-log-path=/var/log/nginx/error.log \

--http-log-path=/var/log/nginx/access.log \

--with-pcre \

--pid-path=/var/run/nginx.pid \

--with-http_ssl_module && \

make && make install

RUN rm -rf /nginx-1.19.2

CMD ["nginx", "-g", "daemon off;"]

Comme vous pouvez le voir, le code à l'intérieur du Dockerfile reflète les sept étapes dont j'ai parlé ci-dessus.

- L'instruction

FROMdéfinit Ubuntu comme image de base, créant un environnement idéal pour construire n'importe quelle application. - L'instruction

RUNinstalle les packages standard nécessaires pour construire NGINX à partir de la source. - L'instruction

COPYici est quelque chose de nouveau. Cette instruction est responsable de la copie du fichiernginx-1.19.2.tar.gzà l'intérieur de l'image. La syntaxe générique de l'instructionCOPYestCOPY <source> <destination>où la source est dans votre système de fichiers local et la destination est à l'intérieur de votre image. Le.comme destination signifie le répertoire de travail à l'intérieur de l'image qui est par défaut/sauf si défini autrement. - La deuxième instruction

RUNici extrait le contenu de l'archive en utilisanttaret s'en débarrasse ensuite. - Le fichier d'archive contient un répertoire appelé

nginx-1.19.2contenant le code source. Donc à l'étape suivante, vous devrezcdà l'intérieur de ce répertoire et effectuer le processus de construction. Vous pouvez lire l'article Comment installer un logiciel à partir du code source... et le supprimer ensuite pour en savoir plus sur le sujet. - Une fois la construction et l'installation terminées, vous supprimez le répertoire

nginx-1.19.2en utilisant la commanderm. - À l'étape finale, vous démarrez NGINX en mode processus unique comme vous l'avez fait auparavant.

Maintenant, pour construire une image en utilisant ce code, exécutez la commande suivante :

docker image build --tag custom-nginx:built .

# Step 1/7 : FROM ubuntu:latest

# ---> d70eaf7277ea

# Step 2/7 : RUN apt-get update && apt-get install build-essential libpcre3 libpcre3-dev zlib1g zlib1g-dev libssl-dev -y && apt-get clean && rm -rf /var/lib/apt/lists/*

# ---> Running in 2d0aa912ea47

### LONG INSTALLATION STUFF GOES HERE ###

# Removing intermediate container 2d0aa912ea47

# ---> cbe1ced3da11

# Step 3/7 : COPY nginx-1.19.2.tar.gz .

# ---> 7202902edf3f

# Step 4/7 : RUN tar -xvf nginx-1.19.2.tar.gz && rm nginx-1.19.2.tar.gz

---> Running in 4a4a95643020

### LONG EXTRACTION STUFF GOES HERE ###

# Removing intermediate container 4a4a95643020

# ---> f9dec072d6d6

# Step 5/7 : RUN cd nginx-1.19.2 && ./configure --sbin-path=/usr/bin/nginx --conf-path=/etc/nginx/nginx.conf --error-log-path=/var/log/nginx/error.log --http-log-path=/var/log/nginx/access.log --with-pcre --pid-path=/var/run/nginx.pid --with-http_ssl_module && make && make install

# ---> Running in b07ba12f921e

### LONG CONFIGURATION AND BUILD STUFF GOES HERE ###

# Removing intermediate container b07ba12f921e

# ---> 5a877edafd8b

# Step 6/7 : RUN rm -rf /nginx-1.19.2

# ---> Running in 947e1d9ba828

# Removing intermediate container 947e1d9ba828

# ---> a7702dc7abb7

# Step 7/7 : CMD ["nginx", "-g", "daemon off;"]

# ---> Running in 3110c7fdbd57

# Removing intermediate container 3110c7fdbd57

# ---> eae55f7369d3

# Successfully built eae55f7369d3

# Successfully tagged custom-nginx:built

Ce code est correct, mais il y a quelques endroits où nous pouvons apporter des améliorations.

- Au lieu de coder en dur le nom de fichier comme