Article original : Build a Stable Diffusion VAE From Scratch using Pytorch

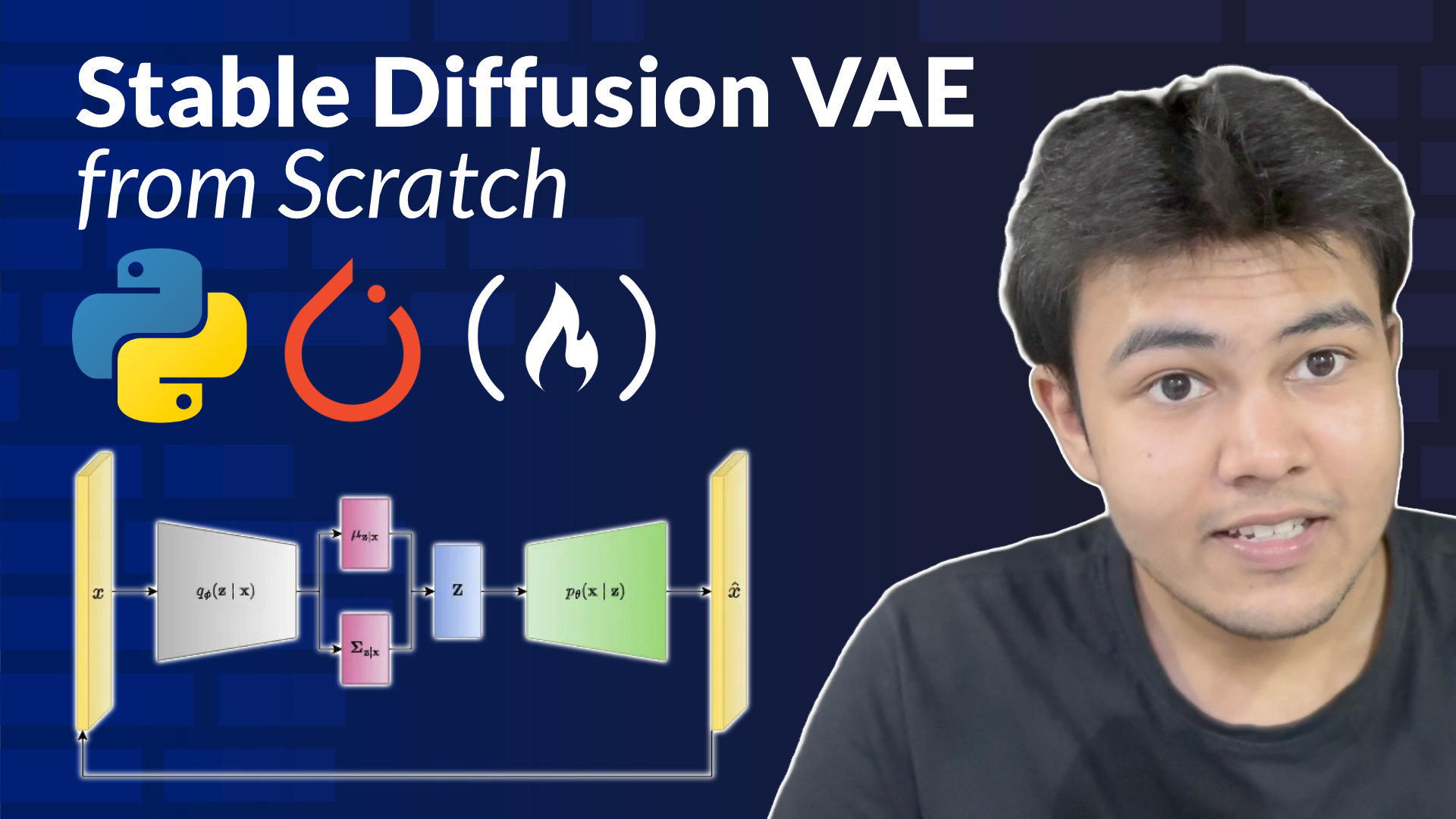

Nous venons de publier un cours sur la chaîne YouTube freeCodeCamp.org qui vous enseignera tout ce que vous devez savoir sur les Variational Autoencoders (VAEs). Ce cours est parfait pour toute personne souhaitant approfondir l'un des concepts fondamentaux derrière les techniques modernes de génération d'images, telles que celles utilisées dans les modèles de diffusion latente et les GANs. Harsh Bhatt a développé ce cours. Il est ingénieur en apprentissage automatique.

Les VAEs sont un type spécial d'autoencodeur qui fonctionne avec des distributions de probabilité au lieu de points fixes dans l'espace latent. Cette capacité permet aux VAEs d'apprendre et de représenter la variabilité dans les ensembles de données, comme les différentes façons dont le chiffre "7" peut apparaître dans les formes manuscrites. En apprenant une moyenne (μ) et un écart-type (σ), le VAE capture efficacement la distribution des données, ce qui en fait un outil essentiel pour les applications en modélisation générative et en apprentissage non supervisé.

Pourquoi apprendre les Variational Autoencoders ?

Les VAEs sont plus qu'une simple étape pour comprendre la génération d'images. Ils résolvent des défis clés en réduction de dimensionnalité et en représentation des données. Contrairement aux autoencodeurs traditionnels, qui se concentrent sur la compression des données en une représentation latente fixe, les VAEs utilisent des méthodes probabilistes pour créer des espaces latents plus lisses et plus significatifs. Cela les rend particulièrement utiles pour des tâches comme :

Synthèse d'images : Générer des images réalistes et diversifiées.

Augmentation de données : Créer de nouveaux échantillons de données pour l'entraînement.

Détection d'anomalies : Identifier les valeurs aberrantes dans les distributions de données.

Ce que vous apprendrez dans ce cours

Ce cours complet commence par introduire les concepts de base des autoencodeurs, y compris l'architecture encodeur-décodeur. Vous explorerez ensuite les différences entre les autoencodeurs standard et les VAEs, en apprenant pourquoi l'encodage des données en distributions de probabilité est un changement de jeu. Les sujets clés abordés incluent :

Représentation de l'espace latent : Comment les VAEs regroupent les points de données similaires en grappes au sein de l'espace latent.

L'astuce de reparamétrisation : Permettre l'optimisation basée sur les gradients en représentant les variables aléatoires de manière différentiable.

Fonctions de perte pour les VAEs : Combiner la perte de reconstruction et la divergence KL pour optimiser le modèle.

Implémentation avec PyTorch : Codage pratique pour construire et entraîner votre propre VAE à partir de zéro.

Implémentation pratique

Le cours vous guide étape par étape à travers l'implémentation d'un VAE en utilisant PyTorch, en commençant par l'architecture de l'encodeur et du décodeur. Vous apprendrez comment :

Encoder des images en une représentation latente.

Décoder les vecteurs latents pour reconstruire les images originales.

Optimiser le modèle en utilisant la perte de reconstruction et la divergence KL.

Visualiser et interpréter l'espace latent.

Vous obtiendrez également des informations sur des techniques avancées comme les couches d'auto-attention pour encoder le contexte et les blocs résiduels pour un entraînement efficace des réseaux de neurones.

Conclusion

Prêt à commencer votre voyage dans la modélisation générative ? Regardez le cours maintenant sur la chaîne YouTube de freeCodeCamp.org et mettez-vous à l'œuvre avec les Variational Autoencoders !