Article original : Going deeper: A history of ideas in AI research

Par Elena Nisioti

L'intelligence artificielle avance rapidement. L'ambiance est partout. Les faits commencent à ressembler à des films de science-fiction et les films de science-fiction à une version de la réalité (avec de meilleurs graphismes). Il se peut que l'IA ait enfin atteint le niveau de maturité qu'elle a poursuivi pendant des décennies et qui lui a été obstinément refusé, rendant une partie de sa communauté, et le monde entier, sceptique quant à sa faisabilité.

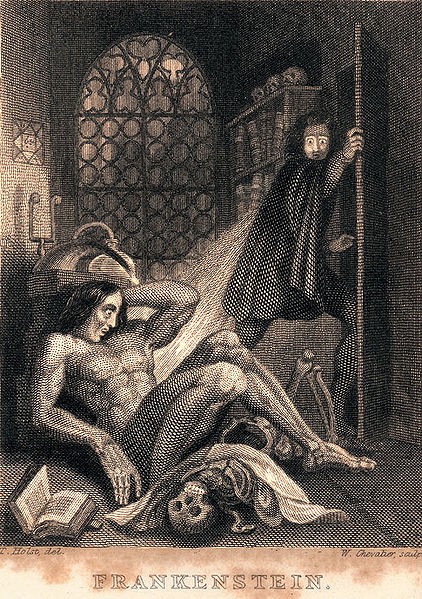

Frankenstein peut contenir des parallèles pertinents pour notre époque. Le roman gothique de Mary Shelley contient une discussion sur les conséquences de la création et de l'introduction d'un être artificiel dans la société. La Créature nous intrigue avec son atrocité inhumaine et pourtant des manifestations humaines de faiblesse, de besoin de compagnie et de crise existentielle.

On pourrait dire que nous devrions nous concentrer sur l'avenir et les conséquences de nos découvertes. Mais comment peut-on se concentrer sur le chaos créé par l'injection d'une armée de Créatures dans un système aussi compliqué que la société contemporaine ? On pourrait aussi se concentrer sur les réalisations, les histoires à succès qui ont rendu ces idées véridiques. Mais comment peut-on, a posteriori, discriminer entre une intuition correcte et la chance ?

Il faut de la retenue et de la sagesse pour mettre de côté, pour un temps, les branches de son travail et évaluer la fermeté de ses racines. Un arbre en fleurs peut être distractif.

Que vous traciez les règles de la pensée logique chez les philosophes grecs anciens, la formulation du raisonnement chez les mathématiciens arabes ou le pouvoir de la connaissance mathématique chez les intellectuels du 19ème siècle — une notion déstabilisante devient claire : les questions sont plus profondes que les réseaux que vous pouvez concevoir (même en tenant compte de la loi de Moore).

"Je crois que ce que nous devenons dépend de ce que nos pères nous enseignent à des moments inattendus, lorsqu'ils n'essayent pas de nous enseigner. Nous sommes formés par de petits morceaux de sagesse."

Umberto Eco

Le reste de la discussion émergera de l'histoire de l'IA. Non pas l'histoire des réalisations, mais l'histoire des questions, des arguments et des croyances de certains individus significatifs. La plupart des événements tournent autour des années 1960, l'ère où l'IA a acquis sa définition officielle, son but, sa communauté scientifique et ses opposants.

Les machines peuvent-elles penser ?

En 1950, Alan Turing tente de répondre à cette question, exprimée de manière délibérément simpliste, dans son article séminal Computing Machinery and Intelligence. Reconnaissant son ambiguïté et les limites qu'elle impose à la compréhension de l'IA, il procède en formulant une expérience de pensée, également connue sous le nom de test de Turing :

Le joueur A est un homme, le joueur B est une femme et le joueur C est de l'un ou l'autre sexe. C joue le rôle de l'interrogateur et ne peut voir aucun des joueurs, mais peut communiquer avec eux par des notes impersonnelles. En posant des questions à A et B, C essaie de déterminer lequel des deux est l'homme et lequel est la femme. Le rôle de A est de tromper l'interrogateur pour qu'il prenne la mauvaise décision, tandis que B tente d'aider l'interrogateur à prendre la bonne.

La question reformulée est alors :

Que se passera-t-il lorsqu'une machine prendra la place de A dans ce jeu ? L'interrogateur se trompera-t-il aussi souvent qu'il le fait lorsque le jeu est joué entre deux humains ?

L'approche de Turing semble suivre la doctrine du test du canard : Si cela ressemble à un canard, nage comme un canard et cancane comme un canard, alors c'est probablement un canard.

Son attitude concernant les aspects « humains » de l'intelligence, tels que la conscience, est que vous ne pouvez pas blâmer quelqu'un (ou quelque chose) pour ne pas posséder une caractéristique que vous n'avez pas encore définie. Ainsi, la conscience est irrelevante dans notre quête de l'IA.

Les théorèmes d'incomplétude de Gödel étaient un obstacle dans la tentative de parler de l'IA. Selon eux, la logique mathématique ne peut être à la fois complète et cohérente, ainsi, les machines équipées de logique mathématique pour apprendre, comme c'est le cas de l'IA, sont censées échouer dans l'apprentissage de certaines vérités. La réponse de Turing à cela est assez désarmante : comment savez-vous que l'intellect humain ne vient pas aussi avec ses limitations ?

L'article de Turing est généreux à la fois en termes d'arguments et de structure dialectique claire, néanmoins contraint dans les spéculations sur les technologies qui restaient à découvrir.

Étapes vers l'intelligence artificielle

Marvin Minsky était l'un des pères de l'IA en tant que domaine de recherche. Dans l'album poussiéreux des photos de famille de l'IA, Minsky serait cet homme âgé qui apporte un certain malaise à un dîner de famille : « Le vieux oncle Minsky. Il était charmant et étrange et avait toujours quelque chose d'intéressant à dire ».

Minsky était l'un des organisateurs de la conférence de Dartmouth en 1956, où l'intelligence artificielle a été définie pour la première fois comme un terme et un domaine. Il est surtout connu pour sa vigueur à croire que l'IA est réalisable et son mépris à la poursuivre avec de mauvais moyens.

Voyons ce que Minsky avait à dire en 1961, lorsqu'on lui a demandé de parler des progrès réalisés jusqu'alors en IA.

Devrions-nous demander ce que l'intelligence est "réellement" ? Mon point de vue est que c'est plus une question esthétique, ou de sens de la dignité, qu'une question technique ! Pour moi, "l'intelligence" semble désigner peu plus que le complexe de performances que nous arrivons à respecter, mais que nous ne comprenons pas. Il en est de même, généralement, avec la question de la "profondeur" en mathématiques. Une fois la preuve d'un théorème vraiment comprise, son contenu semble devenir trivial.

Reconnaissant les difficultés inhérentes à la définition de l'IA, et donc à sa poursuite, Minsky commence par poser les piliers de sa construction. Selon lui, ce sont la recherche, la reconnaissance de formes, l'apprentissage, la planification et l'induction.

Si le but ultime du programme est de rechercher et de trouver des solutions par lui-même, alors la reconnaissance de formes peut l'aider à reconnaître les outils appropriés, l'apprentissage peut l'aider à s'améliorer par l'expérience, et la planification peut conduire à une exploration plus efficace. En ce qui concerne la possibilité de créer une machine avec des capacités inductives et donc de raisonnement, Minsky a ceci à dire :

Maintenant [selon le théorème d'incomplétude de Gödel], il ne peut y avoir de système pour l'inférence inductive qui fonctionnera bien dans tous les univers possibles. Mais étant donné un univers [notre monde], ou un ensemble d'univers, et un critère de succès, ce problème (épistémologique) pour les machines devient technique plutôt que philosophique.

Le reste du texte contient une urgence récurrente à clarifier que la poursuite de l'IA devrait être menée à travers des architectures complexes et hiérarchiques. Pour cette raison, il remet en question l'approche du perceptron, car elle échouera pour des problèmes modérément difficiles. Et franchement, nous ne pouvons pas nous attendre à ce que la réalité soit simpliste.

On peut attribuer à Minsky la responsabilité d'avoir découragé la recherche sur les perceptrons, ce qui a probablement retardé l'essor de l'apprentissage profond. La réalisation que, même en utilisant des blocs de construction simples, on peut résoudre des problèmes compliqués en allant vers des architectures profondes semble avoir échappé à son insight, néanmoins, ingénieux.

Pourtant, ses remarques peuvent être vues comme une critique finalement constructive, car elles ont aidé la communauté à explorer les faiblesses des approches originales. De plus, l'apprentissage profond peut être le meilleur que nous ayons jusqu'à présent (et que les applications sont merveilleuses), mais ne devrait pas être considéré inconditionnellement comme le Saint-Graal de l'IA.

Esprits, cerveaux et programmes

En 1980, John Searle s'est mis en colère. Bien qu'il se soit probablement mis en colère plus tôt, c'est le moment où il a décidé de rendre publique son désaccord avec l'IA forte. En effet, même le titre semble sarcastique. J'ai l'impression que Searle me saisit par le col et, agitant vigoureusement son doigt, dit : « Laissez-moi vous aider à faire quelques distinctions fondamentales, jeune homme ».

"On a l'impression que les gens dans l'IA qui écrivent ce genre de choses pensent qu'ils peuvent s'en tirer parce qu'ils ne le prennent pas vraiment au sérieux, et qu'ils ne pensent pas que les autres le prendront non plus. Je propose, pour un moment au moins, de le prendre au sérieux."

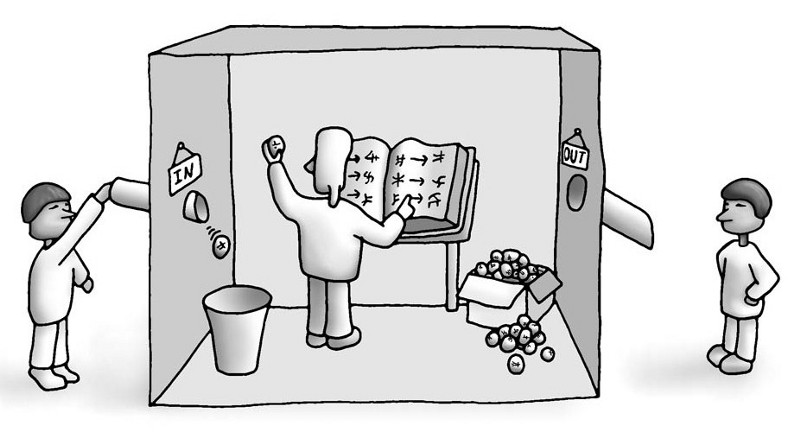

Searle attaque uniquement la notion d'IA forte, qu'il identifie comme la capacité d'un ordinateur à pratiquer tout comportement humain. Il traduit cela en la capacité d'une machine à démontrer de la conscience, qu'il réfute par analogie. Son célèbre expérience de pensée, la chambre chinoise, se présente ainsi :

Vous êtes un locuteur monolingue anglais enfermé dans une pièce avec les éléments suivants : un grand lot d'écriture chinoise (appelé un script), un autre grand lot d'écriture chinoise (appelé une histoire) et un ensemble de règles anglaises vous indiquant comment faire correspondre les symboles chinois du deuxième lot au premier (appelé un programme). Ensuite, on vous donne un autre lot d'écriture chinoise (cette fois appelé des questions) et un autre ensemble d'instructions anglaises avec des règles qui font correspondre les questions aux deux autres lots. Félicitations, vous venez d'apprendre le chinois !

C'est l'expérience de la Chambre chinoise, introduite par Searle en 1980. Une expérience de pensée n'est pas une expérience en soi, car son but n'est pas d'être menée, mais d'explorer les conséquences potentielles d'une idée. La plus ancienne et la plus célèbre est probablement l'expérience de la Tour penchée de Pise de Galilée (avez-vous aussi pensé que Galilée faisait vraiment tomber des pommes de la tour ?).

Le point de Searle est que le fait que vous puissiez produire des réponses chinoises en acceptant des questions chinoises ne signifie pas que vous comprenez le chinois, si cette capacité a été créée en suivant des règles dans une autre langue. Par conséquent, une machine qui donne la sortie attendue après avoir reçu l'algorithme approprié ne devrait pas être considérée comme une entité « pensante ».

Ce que Searle ne conteste pas, c'est la capacité d'un programme à penser, en termes de raisonnement fonctionnel. Il accuse les chercheurs actuels en IA d'être behavioristes et opérationnalistes, car ils tentent d'équivaloir un programme à un esprit (ce qui est vrai), laissant de côté cependant l'importance du cerveau.

Selon lui, la conscience ne vient que des opérations biologiques et puisque un programme est totalement indépendant de son implémentation (car il peut fonctionner sur n'importe quel matériel), il ne peut pas exhiber de conscience.

En lisant le texte original, on a l'impression qu'il attaque une communauté immature de scientifiques informatiques qui n'a pas pris la peine de parvenir à un consensus sur ce qu'est l'intelligence, mais tente néanmoins de la simuler guidée par des approches téléologiques et des spéculations.

La réponse de Minsky à Searle, et aux approches philosophiques en général, est aussi nihiliste que possible : "ils ne comprennent pas, et devraient être ignorés".

Les éléphants ne jouent pas aux échecs.

Et vous ne devriez pas les faire se sentir mal à ce sujet. Cet article, écrit par Rodney A. Brooks en 1990, est une tentative d'un évangéliste de la Nouvelle IA de persuader, en employant à la fois des arguments et sa flotte robotique, que l'approche classique de l'IA devrait laisser de la place à la sienne.

Pour comprendre l'ambiance de cette époque, l'IA traversait son deuxième hiver. Le financement était coupé car les entreprises et les gouvernements réalisaient que la communauté avait fixé les attentes trop haut.

Donc, le temps de l'introspection. Lorsqu'une chose échoue fondamentalement, il y a deux façons de l'aborder : soit elle est impossible à réaliser, soit votre approche est erronée.

Brooks a suggéré que la stagnation de l'IA est due à son dogme des représentations fonctionnelles. L'hypothèse du système de symboles est une vision de longue date sur le fonctionnement de l'intelligence. Selon elle, le monde implique des entités, comme des personnes, des voitures et l'amour cosmique, il est donc naturel de les faire correspondre à des symboles et de nourrir les machines avec eux. Si cette hypothèse est correcte, alors vous avez fourni à la machine toutes les informations nécessaires pour qu'elle « vienne » avec l'intelligence.

Bien que cette hypothèse ne semble pas problématique, elle a quelques conséquences de grande portée qui pourraient expliquer la mauvaise performance de l'IA :

- Le système de symboles n'est pas adéquat pour décrire le monde. Selon le problème du cadre, c'est une fallacie logique de supposer quoi que ce soit qui n'est pas explicitement énoncé. À ce sujet, Brooks suggère charmant : pourquoi ne pas prendre le monde comme son propre modèle ?

- L'intelligence ne peut pas émerger de simples calculs. L'utilisation immense d'heuristiques, nécessaires pour entraîner des algorithmes intelligents, est une contradiction à notre tentative de créer de la connaissance. (Votre recherche sur grille est une insulte à l'intellect humain.)

- L'obsession de l'IA à garantir la généralité d'un modèle appris a conduit à un phénomène que Brooks appelle la puzzlitis : un effort excessif donné pour prouver que l'algorithme fonctionne dans des cas obscurs. C'est certainement une capacité attrayante, mais elle ne semble pas être une conséquence fondamentale de la connaissance et notre monde est plutôt cohérent.

La contre-proposition de Brooks est l'hypothèse de l'ancrage physique. C'est-à-dire, permettre à l'intelligence artificielle d'interagir directement avec le monde et de l'utiliser comme sa propre représentation. Cela change certainement la pratique standard de l'IA : de l'apprentissage nécessitant d'immenses ressources computationnelles, des conseils d'experts et un besoin jamais satisfait de données d'entraînement, Brooks suggère d'équiper des entités physiques avec du matériel bon marché et de les libérer dans le monde. Mais cela sous-estime-t-il le problème ?

Brooks voit l'intelligence émerger du comportement collectif, et non de parties sophistiquées. Peut-être que l'observation la plus profonde de ses expériences concerne la manière dont "le comportement dirigé par un but émerge des interactions de comportements plus simples non dirigés par un but". Il n'est pas nécessaire qu'il existe un modèle de coordination prédéterminé, car une machine intelligente devrait élaborer ses propres stratégies pour interagir de manière optimale avec le monde.

L'argument de Brooks sur l'évolution nous persuade de l'importance de l'hypothèse de l'ancrage physique : les humains sont l'exemple le plus commun et le plus proche que nous ayons de l'intelligence. Ainsi, dans notre tentative de recréer cette caractéristique, n'est-il pas naturel d'observer l'évolution, un processus lent et adaptatif qui a progressivement conduit à la formulation de la civilisation humaine ? Maintenant, si l'on considère le temps qu'il nous a fallu pour développer des compétences telles que l'interaction, la reproduction et la survie, en contraste avec nos capacités encore jeunes d'utiliser un langage ou de jouer aux échecs, alors on peut parvenir à la conclusion que ce sont les compétences les plus difficiles à développer. Alors, pourquoi ne pas se concentrer sur cela ?

Bien qu'enthousiaste quant à la praticité de son approche, Brooks reconnaît ses limitations théoriques, qui peuvent être attribuées au fait que nous n'avons pas encore développé une compréhension complète de la dynamique des populations interagissantes. Une fois de plus, le mépris d'un ingénieur envers les objections philosophiques est évident :

"Au moins, si notre stratégie ne convainc pas les philosophes de fauteuil, notre approche ingénierique aura radicalement changé le monde dans lequel nous vivons."

L'IA manifeste le progrès

Malgré le fait de flotter dans un océan de questions, l'IA manifeste quelque chose que nous ne pouvons pas contester : le progrès. Néanmoins, enlever aux applications actuelles l'effet des avancées technologiques et des avantages heuristiques pour acquérir une perception précise de la qualité de la recherche actuelle est une tâche fastidieuse.

L'apprentissage profond prouvera-t-il être un outil digne de satisfaire nos critères toujours plus exigeants d'intelligence ? Ou est-ce une autre période interglaciaire avant que l'IA n'atteigne à nouveau l'hiver ?

De plus, les préoccupations et les questions ont évolué de purement philosophiques à sociales, car les conséquences de l'IA dans la vie quotidienne deviennent plus évidentes et pressantes que le besoin de comprendre la conscience, Dieu et l'intelligence. Pourtant, cela peut être une question encore plus difficile à répondre et nous inciter à creuser encore plus profondément.

Lorsque Wittgenstein a écrit le Tractactus, il a été confronté au danger d'une fallacie fondamentale : ses arguments sont devenus victimes de la doctrine de son œuvre. C'est-à-dire, si l'on acceptait sa doctrine comme vraie, ses arguments étaient illogiques et donc sa doctrine devait être fausse. Mais Wittgenstein pensait différemment :

"Mes propositions sont éclairantes de cette manière : celui qui me comprend finit par les reconnaître comme dénuées de sens, lorsqu'il a grimpé à travers elles, sur elles, par-dessus elles."

Pour comprendre la vérité derrière une idée compliquée, nous devons évoluer. Nous devons rester fermes sur notre étape précédente et être prêts à l'abandonner. Chaque étape n'a pas besoin d'être correcte, mais elle doit être comprise. Plus tard, confronté à cet argument, Wittgenstein a dit qu'il n'avait pas besoin d'une échelle, car il était capable d'aborder directement la vérité.

Nous en avons peut-être encore besoin.